NEWS

[gelöst] Widget für RTSP Stream

-

nein,es geht nicht und es liegt am Browser,nicht am IOBroker.

Installiere Dir MotionEye und alles wird gut.

Danke für den Tip! Hab ich gemacht! Funktioniert einwandfrei!

-

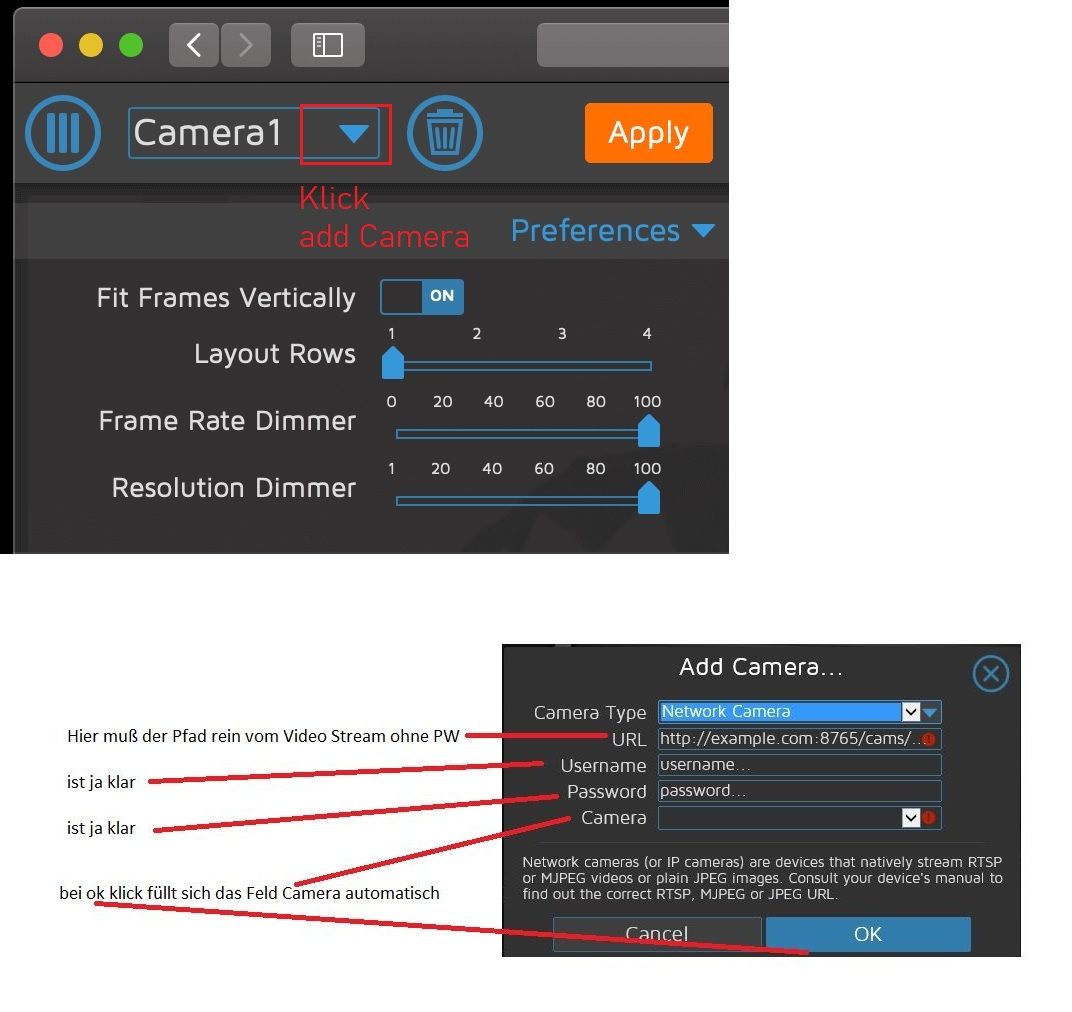

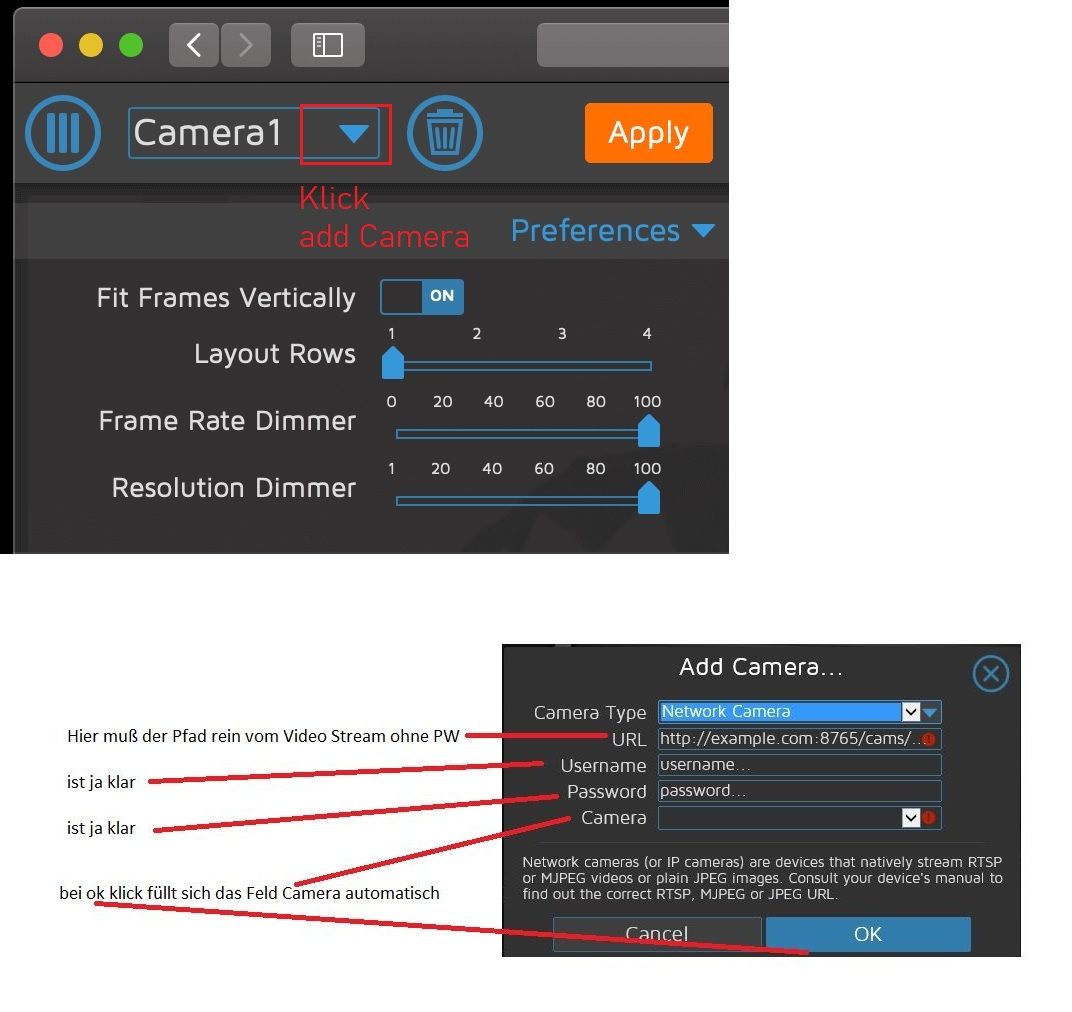

Moin, ich habe zwei RTSP Streams, einwandfrei.

Das Problem sind User/PASS, immer wieder das leidige Thema.

Es liegt nicht am IOBroker sondern an den Restriktionen aus einem Container heraus.Die Lösung ist aber ganz einfach.

Installiert Euch MotionEye, übergebt dort den rtsp Stream, und ihr bekommt

einen Stream ohne User/Pass zurück.

Den in ein normales Image Widget packen, fertig.@skokarl sagte in [gelöst] Widget für RTSP Stream:

Moin, ich habe zwei RTSP Streams, einwandfrei.

Das Problem sind User/PASS, immer wieder das leidige Thema.

Es liegt nicht am IOBroker sondern an den Restriktionen aus einem Container heraus.Die Lösung ist aber ganz einfach.

Installiert Euch MotionEye, übergebt dort den rtsp Stream, und ihr bekommt

einen Stream ohne User/Pass zurück.

Den in ein normales Image Widget packen, fertig.Gesucht, gefunden, der entscheidene Tipp mit MotionEye und es läuft endlich, Danke @skokarl

-

@skokarl sagte in [gelöst] Widget für RTSP Stream:

Moin, ich habe zwei RTSP Streams, einwandfrei.

Das Problem sind User/PASS, immer wieder das leidige Thema.

Es liegt nicht am IOBroker sondern an den Restriktionen aus einem Container heraus.Die Lösung ist aber ganz einfach.

Installiert Euch MotionEye, übergebt dort den rtsp Stream, und ihr bekommt

einen Stream ohne User/Pass zurück.

Den in ein normales Image Widget packen, fertig.Gesucht, gefunden, der entscheidene Tipp mit MotionEye und es läuft endlich, Danke @skokarl

-

@skokarl sagte in [gelöst] Widget für RTSP Stream:

Ich hab eben gesehen Du hast ne Synology

Der Synology Adapter wurde wohl gründlich überarbeitet, und dort soll

man mittlerweile auch die Streams von der Surviellance Station abgreifen können.

Ungetestet, aber klingt gut, spart man sich evtl. MotioneyeDen Thread hatte ich schon gelesen und bei mir lief der nicht, aber ich werde nochmal testen.

Die Kameras laufen auf einer uralten einfachen Syno vllt klappt es deswegen nicht, mal sehen.

Trotzdem Danke für den Hinweis ;-) -

@skokarl sagte in [gelöst] Widget für RTSP Stream:

Moin, ich habe zwei RTSP Streams, einwandfrei.

Das Problem sind User/PASS, immer wieder das leidige Thema.

Es liegt nicht am IOBroker sondern an den Restriktionen aus einem Container heraus.Die Lösung ist aber ganz einfach.

Installiert Euch MotionEye, übergebt dort den rtsp Stream, und ihr bekommt

einen Stream ohne User/Pass zurück.

Den in ein normales Image Widget packen, fertig.Gesucht, gefunden, der entscheidene Tipp mit MotionEye und es läuft endlich, Danke @skokarl

@Nashra said in [gelöst] Widget für RTSP Stream:

@skokarl sagte in [gelöst] Widget für RTSP Stream:

Moin, ich habe zwei RTSP Streams, einwandfrei.

Das Problem sind User/PASS, immer wieder das leidige Thema.

Es liegt nicht am IOBroker sondern an den Restriktionen aus einem Container heraus.Die Lösung ist aber ganz einfach.

Installiert Euch MotionEye, übergebt dort den rtsp Stream, und ihr bekommt

einen Stream ohne User/Pass zurück.

Den in ein normales Image Widget packen, fertig.Gesucht, gefunden, der entscheidene Tipp mit MotionEye und es läuft endlich, Danke @skokarl

Hallo, eine Kamera habe ich in meine VIS drin ueber motioneye. Aber, wie bekomme ich eine zweite/dritte Kam rein? Wie lauten die weiteren Adressen von Motioneye fuer die weiteren Cams?

-

@Nashra said in [gelöst] Widget für RTSP Stream:

@skokarl sagte in [gelöst] Widget für RTSP Stream:

Moin, ich habe zwei RTSP Streams, einwandfrei.

Das Problem sind User/PASS, immer wieder das leidige Thema.

Es liegt nicht am IOBroker sondern an den Restriktionen aus einem Container heraus.Die Lösung ist aber ganz einfach.

Installiert Euch MotionEye, übergebt dort den rtsp Stream, und ihr bekommt

einen Stream ohne User/Pass zurück.

Den in ein normales Image Widget packen, fertig.Gesucht, gefunden, der entscheidene Tipp mit MotionEye und es läuft endlich, Danke @skokarl

Hallo, eine Kamera habe ich in meine VIS drin ueber motioneye. Aber, wie bekomme ich eine zweite/dritte Kam rein? Wie lauten die weiteren Adressen von Motioneye fuer die weiteren Cams?

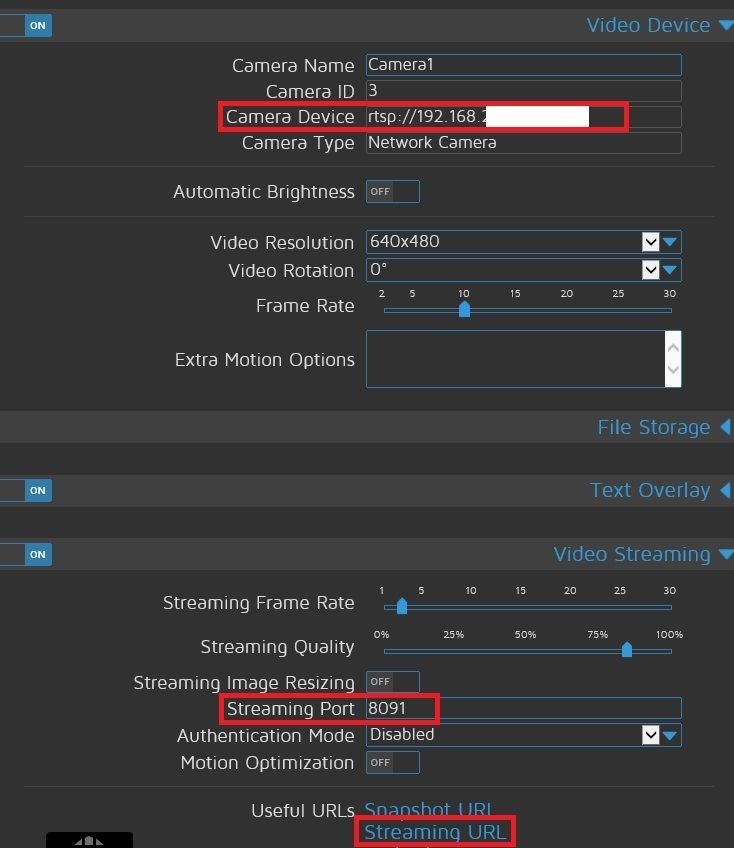

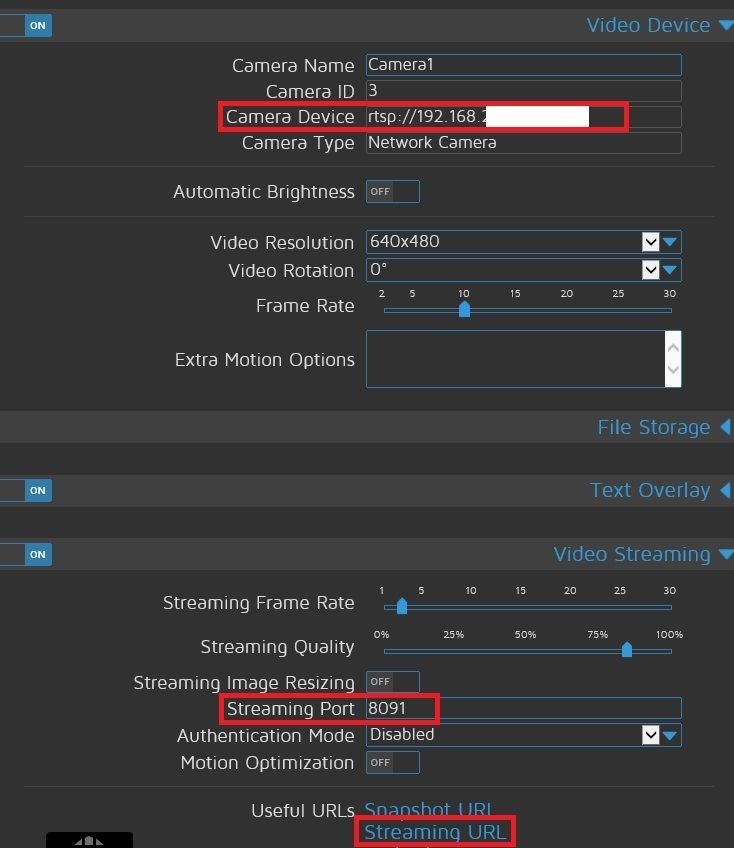

zweite dritte Cam müssen zuerst in Motioneye angelegt sein.

URL steht dann unter Streaming URL.

-

zweite dritte Cam müssen zuerst in Motioneye angelegt sein.

URL steht dann unter Streaming URL.

-

Hallo,

vermutlich bin ich hier nicht richtig, komme einfach nicht weiter. Folgende Fragen :- Habe MotionEye installiert und läuft auch. Wenn ich nun meine eingebundenen Kameras in einem iFrame in Vis einbinde, kommt meist ein Fenster mit Scrollbalken und das Live Bild ist gezoomt. Das krige ich einfach nicht geregelt. Weis da jemand, woran es liegt ?

- Wenn ich in MotionEye eine Kamera eingebunden habe, kann ich sie dort nicht editieren, kann doch nicht sein, dass sie jedesmal neu gemacht werden muss, oder ?

Danke im Voraus

-

Hallo,

vermutlich bin ich hier nicht richtig, komme einfach nicht weiter. Folgende Fragen :- Habe MotionEye installiert und läuft auch. Wenn ich nun meine eingebundenen Kameras in einem iFrame in Vis einbinde, kommt meist ein Fenster mit Scrollbalken und das Live Bild ist gezoomt. Das krige ich einfach nicht geregelt. Weis da jemand, woran es liegt ?

- Wenn ich in MotionEye eine Kamera eingebunden habe, kann ich sie dort nicht editieren, kann doch nicht sein, dass sie jedesmal neu gemacht werden muss, oder ?

Danke im Voraus

zu 1 : geht Basis Iframe oder jqui-mfd-Cam/Video probiere das zweite

Bitte Suche benutzen schon 1000 mal besprochen

zu 2 : editieren geht nicht kannste nur neu anlegen

Was soll das gemecker ? Prog doch mal selbst.

1 mal Copy und Paste und den Port zu ändern ist dir zu viel.

Dann kaufe Fertigprodukte. -

zu 1 : geht Basis Iframe oder jqui-mfd-Cam/Video probiere das zweite

Bitte Suche benutzen schon 1000 mal besprochen

zu 2 : editieren geht nicht kannste nur neu anlegen

Was soll das gemecker ? Prog doch mal selbst.

1 mal Copy und Paste und den Port zu ändern ist dir zu viel.

Dann kaufe Fertigprodukte. -

@Ralla66 sagte in [gelöst] Widget für RTSP Stream:

1 mal Copy und Paste und den Port zu ändern ist dir zu viel.

Dann kaufe Fertigprodukte.warum so agressiv ?? Bin Anfänger, da wird man doch mal fragen dürfen !!

Hallo zusammen,

ich habe in meinem Dashboard im Wohnzimmer bei der Aktion "klingeln" oder "Person erkannt" ein Vollbild-Popup, welches mir die Kamera im Eingang einzeigt. Der Quellstream der Kamera ist auch RTSP.

Wie oft vorgeschlagen, habe ich bisher MotionEye eingesetzt, um den RTSP-Stream in einen MJPEG Stream umzuwandeln. Das funktioniert auch, hat allerdings ein paar Nachteile:- das Transcodieren kostet Rechenleistung, welche auf meinem Pi4 nicht unendlich sind

- Das schnellzyklische Laden eines JPEGs in VIS erzeugt streifen im Bild

- Das Verwenden des MotionEye-eigenen Frames für den Stream klappt besser, allerdings wird das Bild auch nie wirklich flüssig.

Daher habe ich nach zwei Jahren jetzt nochmal gesucht und wollte mich nochmal den neuen Technologien wie WebRTC und HLS Streaming widmen. Bisherige Versuche scheiterten immer an der zu hohen Latenz, also einem Zeitversatz im Bild.

Jetzt habe ich folgendes Projekt gefunden: https://github.com/vladmandic/stream-rtsp

Vorteile:- es verpackt (encapsulates) den Stream nur neu und wandelt ihn nicht um

- das mitgelieferte frame ist ready-to-go und kann direkt in ioBroker eingebunden werden

- der Stream läuft flüssig, wie ein echter RTSP stream

- die zu beobachtende Latenz ist bei mir kleiner als 0,5s

- es ist ein kleines Projekt was recht einfach zu konfigurieren ist

- es verbraucht ~2% CPU auf meinem Pi4

Nachteil: - man muss es noch als service verpacken, damit es schön im Hintergrund laufen kann

Ich finde die Lösung vom Ergebnis viel besser als die MotionEye Lösung. Wobei man dann natürlich den ganzen Recording schnick-Schnack nicht hat. Wer aber nur den Stream flüssig durchleiten will (und wie ich dabei ggf. trotzdem MotionEye für das Recording laufen lässt), der sollte sich das mal ansehen.

Viele Grüße

SEB -

Hallo zusammen,

ich habe in meinem Dashboard im Wohnzimmer bei der Aktion "klingeln" oder "Person erkannt" ein Vollbild-Popup, welches mir die Kamera im Eingang einzeigt. Der Quellstream der Kamera ist auch RTSP.

Wie oft vorgeschlagen, habe ich bisher MotionEye eingesetzt, um den RTSP-Stream in einen MJPEG Stream umzuwandeln. Das funktioniert auch, hat allerdings ein paar Nachteile:- das Transcodieren kostet Rechenleistung, welche auf meinem Pi4 nicht unendlich sind

- Das schnellzyklische Laden eines JPEGs in VIS erzeugt streifen im Bild

- Das Verwenden des MotionEye-eigenen Frames für den Stream klappt besser, allerdings wird das Bild auch nie wirklich flüssig.

Daher habe ich nach zwei Jahren jetzt nochmal gesucht und wollte mich nochmal den neuen Technologien wie WebRTC und HLS Streaming widmen. Bisherige Versuche scheiterten immer an der zu hohen Latenz, also einem Zeitversatz im Bild.

Jetzt habe ich folgendes Projekt gefunden: https://github.com/vladmandic/stream-rtsp

Vorteile:- es verpackt (encapsulates) den Stream nur neu und wandelt ihn nicht um

- das mitgelieferte frame ist ready-to-go und kann direkt in ioBroker eingebunden werden

- der Stream läuft flüssig, wie ein echter RTSP stream

- die zu beobachtende Latenz ist bei mir kleiner als 0,5s

- es ist ein kleines Projekt was recht einfach zu konfigurieren ist

- es verbraucht ~2% CPU auf meinem Pi4

Nachteil: - man muss es noch als service verpacken, damit es schön im Hintergrund laufen kann

Ich finde die Lösung vom Ergebnis viel besser als die MotionEye Lösung. Wobei man dann natürlich den ganzen Recording schnick-Schnack nicht hat. Wer aber nur den Stream flüssig durchleiten will (und wie ich dabei ggf. trotzdem MotionEye für das Recording laufen lässt), der sollte sich das mal ansehen.

Viele Grüße

SEB@seb2010 sagte in [gelöst] Widget für RTSP Stream:

und wie ich dabei ggf. trotzdem MotionEye für das Recording laufen lässt

Aber dann sparst du doch nicht wirklich Rechenleistung wenn Motioneye weiterhin läuft, oder wie sieht das bei dir aus?

-

Hallo zusammen,

ich habe in meinem Dashboard im Wohnzimmer bei der Aktion "klingeln" oder "Person erkannt" ein Vollbild-Popup, welches mir die Kamera im Eingang einzeigt. Der Quellstream der Kamera ist auch RTSP.

Wie oft vorgeschlagen, habe ich bisher MotionEye eingesetzt, um den RTSP-Stream in einen MJPEG Stream umzuwandeln. Das funktioniert auch, hat allerdings ein paar Nachteile:- das Transcodieren kostet Rechenleistung, welche auf meinem Pi4 nicht unendlich sind

- Das schnellzyklische Laden eines JPEGs in VIS erzeugt streifen im Bild

- Das Verwenden des MotionEye-eigenen Frames für den Stream klappt besser, allerdings wird das Bild auch nie wirklich flüssig.

Daher habe ich nach zwei Jahren jetzt nochmal gesucht und wollte mich nochmal den neuen Technologien wie WebRTC und HLS Streaming widmen. Bisherige Versuche scheiterten immer an der zu hohen Latenz, also einem Zeitversatz im Bild.

Jetzt habe ich folgendes Projekt gefunden: https://github.com/vladmandic/stream-rtsp

Vorteile:- es verpackt (encapsulates) den Stream nur neu und wandelt ihn nicht um

- das mitgelieferte frame ist ready-to-go und kann direkt in ioBroker eingebunden werden

- der Stream läuft flüssig, wie ein echter RTSP stream

- die zu beobachtende Latenz ist bei mir kleiner als 0,5s

- es ist ein kleines Projekt was recht einfach zu konfigurieren ist

- es verbraucht ~2% CPU auf meinem Pi4

Nachteil: - man muss es noch als service verpacken, damit es schön im Hintergrund laufen kann

Ich finde die Lösung vom Ergebnis viel besser als die MotionEye Lösung. Wobei man dann natürlich den ganzen Recording schnick-Schnack nicht hat. Wer aber nur den Stream flüssig durchleiten will (und wie ich dabei ggf. trotzdem MotionEye für das Recording laufen lässt), der sollte sich das mal ansehen.

Viele Grüße

SEB@seb2010 Wenn ich das richtig verstanden habe dann kann ich anstatt Motion Eye auch Frigate verwenden um Personen usw. zu erkennen und das ganze aufnehmen. Frigate kann RTSP Restreamen aber dann hab ich das ganze nicht in der VIS.

Mit dem verlinkten "stream-rtsp" kann ich dann den RTSP Restream in die VIS bringen? Bisher bin ich nur noch nicht drauf gekommen wie man das lauffähig bekommt und welche Version ich nutzen muss.

Hast du da einen Tipp für mich?

Danke und viele Grüße

Patrick -

@seb2010 Wenn ich das richtig verstanden habe dann kann ich anstatt Motion Eye auch Frigate verwenden um Personen usw. zu erkennen und das ganze aufnehmen. Frigate kann RTSP Restreamen aber dann hab ich das ganze nicht in der VIS.

Mit dem verlinkten "stream-rtsp" kann ich dann den RTSP Restream in die VIS bringen? Bisher bin ich nur noch nicht drauf gekommen wie man das lauffähig bekommt und welche Version ich nutzen muss.

Hast du da einen Tipp für mich?

Danke und viele Grüße

PatrickHallo Patrick, ich habe Frigate schon seit ner Weile im Einsatz und es läuft mit der Personen und Objekterkennung einfach genial. Die Unterscheidung zwischen Katze, Hund und Vogel funktioniert zwar nicht zu 100% (was aber auch an meinen Einstellungen liegen kann) aber es kommt ja mehr auf die Erkennung von Personen an und das läuft einfach.

Ist aber auf jeden Fall anzuraten einen Google Coral TPU zu verwenden. der Gewaltig die Rechenlast vom Prozessor reduziert, weil dieser dann die Berechnungen durchführt.Frigate gibt es seit diesen Jahr in der Version 0.12.0 und hat jetzt die Integration von go2rtc

Damit und den iframe-Widget ist es nun möglich das Livebild inkl. Ton in der VIS anzuzeigen! -

Hallo Patrick, ich habe Frigate schon seit ner Weile im Einsatz und es läuft mit der Personen und Objekterkennung einfach genial. Die Unterscheidung zwischen Katze, Hund und Vogel funktioniert zwar nicht zu 100% (was aber auch an meinen Einstellungen liegen kann) aber es kommt ja mehr auf die Erkennung von Personen an und das läuft einfach.

Ist aber auf jeden Fall anzuraten einen Google Coral TPU zu verwenden. der Gewaltig die Rechenlast vom Prozessor reduziert, weil dieser dann die Berechnungen durchführt.Frigate gibt es seit diesen Jahr in der Version 0.12.0 und hat jetzt die Integration von go2rtc

Damit und den iframe-Widget ist es nun möglich das Livebild inkl. Ton in der VIS anzuzeigen!@sidm sagte in [gelöst] Widget für RTSP Stream:

Ist aber auf jeden Fall anzuraten einen Google Coral TPU zu verwenden.

Ich denke bis 2 Kamerastreams geht es auch ohne, vorausgesetzt man installiert frigate nicht gerade auf einem Raspi.

Auf einem Intel i5-6300 komme ich ohne Coral TPU und der Vino Erkennung mit 2 Streams auf ca. 3-5% CPU-Last ohne Transcoding. Mit Corel Dual TPU auf 1-3%. -

Hat einer Frigate in einen Proxmox LXC installiert?

Ich weiss, läuft eigentlich unter docker und am besten Nativ. Ich habe den Github Eintrag zur Proxmox installation schon gelesen allerdings würde mich interessieren ob es einen Vergleich gibt zu Frigate (CT & Docker) und Motioneye (CT)

-

Hat einer Frigate in einen Proxmox LXC installiert?

Ich weiss, läuft eigentlich unter docker und am besten Nativ. Ich habe den Github Eintrag zur Proxmox installation schon gelesen allerdings würde mich interessieren ob es einen Vergleich gibt zu Frigate (CT & Docker) und Motioneye (CT)

-

@wendy2702 ,

ja läuft hervorragend. -

@wendy2702 sagte in [gelöst] Widget für RTSP Stream:

@wal mit Google Beschleuniger ?

ja, siehe hier.

-

Hallo Patrick, ich habe Frigate schon seit ner Weile im Einsatz und es läuft mit der Personen und Objekterkennung einfach genial. Die Unterscheidung zwischen Katze, Hund und Vogel funktioniert zwar nicht zu 100% (was aber auch an meinen Einstellungen liegen kann) aber es kommt ja mehr auf die Erkennung von Personen an und das läuft einfach.

Ist aber auf jeden Fall anzuraten einen Google Coral TPU zu verwenden. der Gewaltig die Rechenlast vom Prozessor reduziert, weil dieser dann die Berechnungen durchführt.Frigate gibt es seit diesen Jahr in der Version 0.12.0 und hat jetzt die Integration von go2rtc

Damit und den iframe-Widget ist es nun möglich das Livebild inkl. Ton in der VIS anzuzeigen!@sidm sagte in [gelöst] Widget für RTSP Stream:

Frigate gibt es seit diesen Jahr in der Version 0.12.0 und hat jetzt die Integration von go2rtc

Damit und den iframe-Widget ist es nun möglich das Livebild inkl. Ton in der VIS anzuzeigen!Hast du dazu mal ein Beispiel Config? Aktuell teste ich mit einer Reolink E1 Zoom und probiere jetzt schon mehrere Tage das go2rtc so aufzubereiten dass es die VIS anzeigen kann. Irgendwo ist da noch ein Knoten bei mir im Hirn.

Der Coral USB ist schon im Warenkorb.

Grüße

Patrick

Hey! Du scheinst an dieser Unterhaltung interessiert zu sein, hast aber noch kein Konto.

Hast du es satt, bei jedem Besuch durch die gleichen Beiträge zu scrollen? Wenn du dich für ein Konto anmeldest, kommst du immer genau dorthin zurück, wo du zuvor warst, und kannst dich über neue Antworten benachrichtigen lassen (entweder per E-Mail oder Push-Benachrichtigung). Du kannst auch Lesezeichen speichern und Beiträge positiv bewerten, um anderen Community-Mitgliedern deine Wertschätzung zu zeigen.

Mit deinem Input könnte dieser Beitrag noch besser werden 💗

Registrieren Anmelden