NEWS

iobroker hochverfügbar

-

@apollon77 sagte in iobroker hochverfügbar:

@darkiop wenn alles am gleichen Switch hängt ist ja erstmal easy mit Netzwerk. Die backplane hat meistens ne viel höhere Leistung. Dann user nur dein Switch halt auch ein SPOF :-)

Ja - das ist klar - aber das Risiko gehe ich erstmal ein.

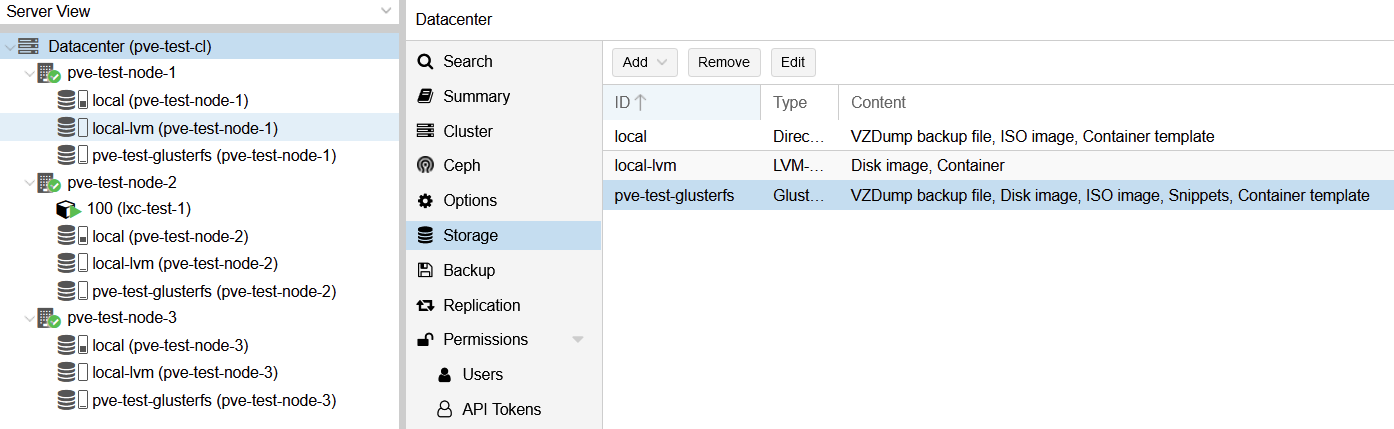

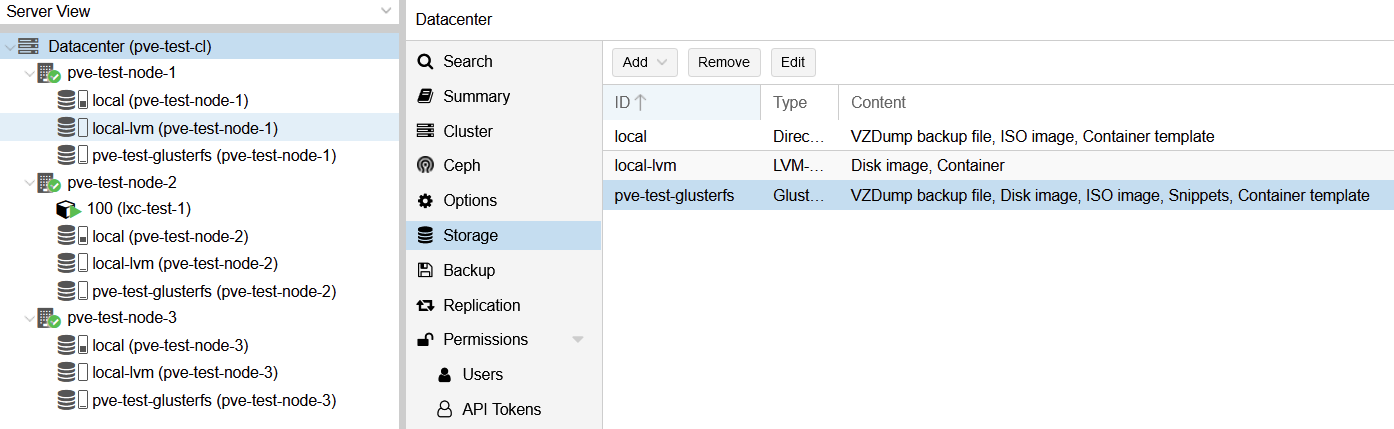

Hab heut Morgen mit meinen 3 VMs mal mit GlusterFS gespielt, installation + config liefen ohne größere hürden. Doku im Anhang.

Aber eine Frage: GlusterFS kann nicht mit LXCs umgehen? Hast du das bei dir gelöst? Wenn ja, wie? :D

https://forum.proxmox.com/threads/container-on-gluster-volume-not-possible.40889/

@darkiop antworte ich dir heute Abend. Da muss ich an en Laptop. Da muss man bissl Tricksen. Und ja mir lxc soll es Performance technisch nicht ideal sein. Ich hatte bisher keine issues damit.

Die drei vms sind jetzt bei dir nicht HA sondern eine vm pro node fest. Gell? Mit Autostart on Boot? Dann könnte das vllt gehen.

Heißt du startest die vms mit dem proxmox node ind definierest das dann als glusterfs Host? Coole Idee. -

@apollon77 sagte in iobroker hochverfügbar:

@darkiop wenn alles am gleichen Switch hängt ist ja erstmal easy mit Netzwerk. Die backplane hat meistens ne viel höhere Leistung. Dann user nur dein Switch halt auch ein SPOF :-)

Ja - das ist klar - aber das Risiko gehe ich erstmal ein.

Hab heut Morgen mit meinen 3 VMs mal mit GlusterFS gespielt, installation + config liefen ohne größere hürden. Doku im Anhang.

Aber eine Frage: GlusterFS kann nicht mit LXCs umgehen? Hast du das bei dir gelöst? Wenn ja, wie? :D

https://forum.proxmox.com/threads/container-on-gluster-volume-not-possible.40889/

@darkiop zur Anleitung ein Feedback: du kann’s es gleich mit replica 3 anlegen. Also muss kein „erst zwei dann Rest“ machen

Aber mach mal noch keine Daten rein!!!! Du brauchst für vm Hosting ein paar spezielle Einstellungen!! Die kannst du mit Daten drin nicht gescheit setzen.

-

@darkiop antworte ich dir heute Abend. Da muss ich an en Laptop. Da muss man bissl Tricksen. Und ja mir lxc soll es Performance technisch nicht ideal sein. Ich hatte bisher keine issues damit.

Die drei vms sind jetzt bei dir nicht HA sondern eine vm pro node fest. Gell? Mit Autostart on Boot? Dann könnte das vllt gehen.

Heißt du startest die vms mit dem proxmox node ind definierest das dann als glusterfs Host? Coole Idee.@apollon77 sagte in iobroker hochverfügbar:

@darkiop antworte ich dir heute Abend. Da muss ich an en Laptop. Da muss man bissl Tricksen. Und ja mir lxc soll es Performance technisch nicht ideal sein. Ich hatte bisher keine issues damit.

Ok, eilt nicht - auch frühestens heut spät Abend wieder schauen. Performance sollte für zuhause vermutlich trotzdem passen.

Die drei vms sind jetzt bei dir nicht HA sondern eine vm pro node fest. Gell? Mit Autostart on Boot? Dann könnte das vllt gehen.

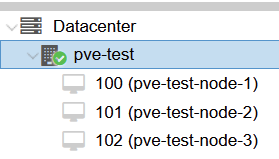

Heißt du startest die vms mit dem proxmox node ind definierest das dann als glusterfs Host? Coole Idee.Die 3 Nodes auf dem Screen sind die 3 VMs mit Proxmox. Innerhalb dieser teste ich dann GlusterFS und Co. Auf pve-test ist Proxmox direkt aufm Blech installiert :)

@apollon77 sagte in iobroker hochverfügbar:

@darkiop zur Anleitung ein Feedback: du kann’s es gleich mit replica 3 anlegen. Also muss kein „erst zwei dann Rest“ machen

Musste grad eh alles zurücksetzen, teste ich dann beim nächsten mal :)

Aber mach mal noch keine Daten rein!!!! Du brauchst für vm Hosting ein paar spezielle Einstellungen!! Die kannst du mit Daten drin nicht gescheit setzen.

Ok :)

-

Ahhh ok hast also IN den VMs auch proxmox und testet da nen proxmox cluser ... auch ne Idee :-)

Also dann ... (kam doch kurz dazu)

- nach aufsetzen des glusterfs volumes noch ein

gluster volume set <VOLNAME> group virtmachen. Das setzt einige Settings sodass sie besser für vms und grössere mages geeignet sind. - prüfen dann mit

gluster volume infoMindestens "features.shard=on" sollte dabei sein ... dann hats geklappt. Sharding heisst das er die echten Files in Chunks von zB nur 64MB aufteilt ... geht dann beim "healing" schneller. Was die anderen Settings alle bedeuten -> https://access.redhat.com/documentation/en-us/red_hat_gluster_storage/3.1/html/administration_guide/chap-managing_red_hat_storage_volumes#Configuring_Volume_Options - Erst dann Daten reinkopieren

Dann empfehle ich "gstatus" als "Monitoring Tool"

- Install: https://github.com/gluster/gstatus#install

- Aufruf überblick nur

gstatus... detailliert `gstatus -a -b´ - Sobald du irgendwas gemacht hast wie updates oder so danach da rein schauen. Vor allem schauen ob Files ein healing machen oder brauchen!

- GlusterFS low level befehl für details

gluster volume status <VOLNAME> detail... so zum merken Da sieht man bei heals noch mehr.

Welche Glusterfs Version hast Du jetzt drauf? Bei proxmox dabei ist ne recht alte. Aktuell ist 9.x ... ich bin auf 8.x ...

-

Vorher Changelog checken! (https://docs.gluster.org/en/latest/release-notes/8.4/)

-

Upgrade Log checken (https://docs.gluster.org/en/latest/Upgrade-Guide/upgrade_to_8/)

-

Proxmox update instructions:

wget -O - https://download.gluster.org/pub/gluster/glusterfs/8/rsa.pub | apt-key add - vi /etc/apt/sources.list.d/gluster.list --> 8 einstellen bzw falls es fehlt halt nochanlegen gluster volume info apt-get update systemctl stop glusterd && systemctl stop glustereventsd && killall glusterfs glusterfsd glusterd glustereventsd apt-get dist-upgrade gluster --version rebootImmer den Proxmx Host nach Update rebooten!

LXC über Proxmox:

- Du hast im proxmox den storage angelegt. Damit mounted proxmox das beim start. mit

mountsiehst Du alles was gerade gemounted ist. Da müsste etwas sein wie "<IP>:<VOLNAME> on /mnt/pve/glusterfs type fuse.glusterfs" - Das jetzt equivalent im /etc/fstab reinschreiben als "<IP>:<VOLNAME> /mnt/pve/glusterfs glusterfs defaults,_netdev 0 0". Wichtig ist das /mnt/pve/glusterfs (oder wie auch immer es bei dir heisst). Merken!!

- achja: Wenn glusterfs lokal ist und auf allen nodes dann am besten in der proxmox konfig einfach "localhost" bei der IP angeben, dann regelt glusterfs das ganze mit connection ... und wenn localhost nicht da ist ist was anderes kaputt.

- In Proxmox dann einen "Directory Storage" anlegen und den lässt Du auf das Glusterfx Mount directory zeigen. in storage.cfg sieht das dann so aus (Mount Dir halt anpassen)

dir: glusterfs-container path /mnt/pve/glusterfs content rootdir is_mountpoint yes shared 1Auf dem Kannst Du dann die Container Images ablegen :-)

Ganz wichtig noch ab glusterfs 8:

systemctl status glusterfssharedstorage.service... wenn es das gibt ... deaktivieren!systemctl disable glusterfssharedstorage.servicesystemctl stop glusterfssharedstorage.servicereboot

Das Funkt sonst beim Reboot dazwischen und unmounted die Directory zu früh wo die LXC noch laufen und dann wird es blöd.

Wenn Du jetzt VMs oder Container auf dem glusterfs hast dann mal starten und mal geflaggt als "HA" oder ohne testen das sie beim Booten sauber automatisch hochkommen und beim reboot sauber beendet werden bevor das glusterfs weg ist. Da hab ich einiges rumgemacht mit.

Am besten /var/log/syslog checken nach bem Reboot das da keine Filesystem fehler angezeigt werden. Beim Boot kann es sein das Proxmox mal sagt "ohh mount noch nicht fertig ... muss noch kurz warten" bevor es die LXC startet. Das ist ok und sollte sich dann paar Sekunden später von selbst geben.Offtopic: Proxmox Cluster: Wenn Du NUCs hast dann nutze den Hardware Watchdog!

In /etc/default/pve-ha-manager WATCHDOG_MODULE=iTCO_wdtDann Reboot und im /var/log/syslog suchen nach wdt um zu schauen obs geklappt hat

Dann viel Spass beim experimentieren und wäre cool am Ende eine Anleitung zu haben :-))

- nach aufsetzen des glusterfs volumes noch ein

-

@arteck sagte in iobroker hochverfügbar:

was hab ich Tage damit verbracht.. aber wenns einmal läuft musst du du dich mit dem Ausfall beschäftigen falls das cluster mal nicht will... und so lernt man immer was dazu..

ich habs so wie apollon.. nur mit 5 nucs.. das ganze auch im Haus verteilt an einzelnen USV's.. um beruhig in den Urlaub zu fahren.

Ich muss mir mal Gedanken und einen Plan machen was die nächsten Schritte sind. Und so Sinnvoll ein Schritt nach dem andern gehen :D Das Thema USV schiebe ich auch schon ewig im Kopf rum und vergesse es immer wieder :D Was habt ihr denn für Welche im Einsatz?

der Spass beginnt wenn du eine Update Orgie startest.. mal eben so ist es nicht getan. da können Admins ein Lied von singen..

Das ist es ja jetzt schon, bei >10 LXCs/VMs + diversen anderen Geräten. Aus diesem Grund hab ich letzte Woche in einigen LXCs/VMs unattended-upgrades aktiviert. Ich hatte eigentlich noch nicht Probleme nach einem Update - solange man vorher nicht komplett sein System verwurschtelt hatte :) Mal schauen wann ich die ersten negativen Erfahrungen damit mache :D

@darkiop usv bin ich auf den Apc Modellen mit usb Anschluss. Da dann nut dran. Die Usb gehen direkt auf drei meiner proxmox nodes und da will ich später noch ne fancy Steuerung machen weil das mit glusterfs so ein Thema ist (wieder was besonderes dann). Bei nem replika 3 system ist es ja so das dir eine ausfallen darf und noch alles geht. Wenn aber ggf die zweite Maschine (an zweiter usv als Beispiel) auch knapp wird wegen Batterie dann musst du idealerweise ja bevor die runterfährt alles sauber runterfahren. Also dann auch an der dritten usv die an sich noch gehen würde oder gar nicht betroffen ist.

Idee ist also hier zu Monitoren und falls es kritisch wird mittels proxmox Adapter dann alle vms und lxc zu beenden bevor das glusterfs read only geht und wenn wieder zurück ist wieder hochzufahren. Aber das ist noch ne Idee auf nem Zettel. ;-)

-

Ahhh ok hast also IN den VMs auch proxmox und testet da nen proxmox cluser ... auch ne Idee :-)

Also dann ... (kam doch kurz dazu)

- nach aufsetzen des glusterfs volumes noch ein

gluster volume set <VOLNAME> group virtmachen. Das setzt einige Settings sodass sie besser für vms und grössere mages geeignet sind. - prüfen dann mit

gluster volume infoMindestens "features.shard=on" sollte dabei sein ... dann hats geklappt. Sharding heisst das er die echten Files in Chunks von zB nur 64MB aufteilt ... geht dann beim "healing" schneller. Was die anderen Settings alle bedeuten -> https://access.redhat.com/documentation/en-us/red_hat_gluster_storage/3.1/html/administration_guide/chap-managing_red_hat_storage_volumes#Configuring_Volume_Options - Erst dann Daten reinkopieren

Dann empfehle ich "gstatus" als "Monitoring Tool"

- Install: https://github.com/gluster/gstatus#install

- Aufruf überblick nur

gstatus... detailliert `gstatus -a -b´ - Sobald du irgendwas gemacht hast wie updates oder so danach da rein schauen. Vor allem schauen ob Files ein healing machen oder brauchen!

- GlusterFS low level befehl für details

gluster volume status <VOLNAME> detail... so zum merken Da sieht man bei heals noch mehr.

Welche Glusterfs Version hast Du jetzt drauf? Bei proxmox dabei ist ne recht alte. Aktuell ist 9.x ... ich bin auf 8.x ...

-

Vorher Changelog checken! (https://docs.gluster.org/en/latest/release-notes/8.4/)

-

Upgrade Log checken (https://docs.gluster.org/en/latest/Upgrade-Guide/upgrade_to_8/)

-

Proxmox update instructions:

wget -O - https://download.gluster.org/pub/gluster/glusterfs/8/rsa.pub | apt-key add - vi /etc/apt/sources.list.d/gluster.list --> 8 einstellen bzw falls es fehlt halt nochanlegen gluster volume info apt-get update systemctl stop glusterd && systemctl stop glustereventsd && killall glusterfs glusterfsd glusterd glustereventsd apt-get dist-upgrade gluster --version rebootImmer den Proxmx Host nach Update rebooten!

LXC über Proxmox:

- Du hast im proxmox den storage angelegt. Damit mounted proxmox das beim start. mit

mountsiehst Du alles was gerade gemounted ist. Da müsste etwas sein wie "<IP>:<VOLNAME> on /mnt/pve/glusterfs type fuse.glusterfs" - Das jetzt equivalent im /etc/fstab reinschreiben als "<IP>:<VOLNAME> /mnt/pve/glusterfs glusterfs defaults,_netdev 0 0". Wichtig ist das /mnt/pve/glusterfs (oder wie auch immer es bei dir heisst). Merken!!

- achja: Wenn glusterfs lokal ist und auf allen nodes dann am besten in der proxmox konfig einfach "localhost" bei der IP angeben, dann regelt glusterfs das ganze mit connection ... und wenn localhost nicht da ist ist was anderes kaputt.

- In Proxmox dann einen "Directory Storage" anlegen und den lässt Du auf das Glusterfx Mount directory zeigen. in storage.cfg sieht das dann so aus (Mount Dir halt anpassen)

dir: glusterfs-container path /mnt/pve/glusterfs content rootdir is_mountpoint yes shared 1Auf dem Kannst Du dann die Container Images ablegen :-)

Ganz wichtig noch ab glusterfs 8:

systemctl status glusterfssharedstorage.service... wenn es das gibt ... deaktivieren!systemctl disable glusterfssharedstorage.servicesystemctl stop glusterfssharedstorage.servicereboot

Das Funkt sonst beim Reboot dazwischen und unmounted die Directory zu früh wo die LXC noch laufen und dann wird es blöd.

Wenn Du jetzt VMs oder Container auf dem glusterfs hast dann mal starten und mal geflaggt als "HA" oder ohne testen das sie beim Booten sauber automatisch hochkommen und beim reboot sauber beendet werden bevor das glusterfs weg ist. Da hab ich einiges rumgemacht mit.

Am besten /var/log/syslog checken nach bem Reboot das da keine Filesystem fehler angezeigt werden. Beim Boot kann es sein das Proxmox mal sagt "ohh mount noch nicht fertig ... muss noch kurz warten" bevor es die LXC startet. Das ist ok und sollte sich dann paar Sekunden später von selbst geben.Offtopic: Proxmox Cluster: Wenn Du NUCs hast dann nutze den Hardware Watchdog!

In /etc/default/pve-ha-manager WATCHDOG_MODULE=iTCO_wdtDann Reboot und im /var/log/syslog suchen nach wdt um zu schauen obs geklappt hat

Dann viel Spass beim experimentieren und wäre cool am Ende eine Anleitung zu haben :-))

@apollon77 sagte in iobroker hochverfügbar:

Welche Glusterfs Version hast Du jetzt drauf? Bei proxmox dabei ist ne recht alte. Aktuell ist 9.x ... ich bin auf 8.x ...

┬─[root@pve-test-node-1:/tmp]─[15:46:47] ╰─># glusterfs --version glusterfs 5.5Mit Proxmox 6.4 kommt die 5.5 mit :D Also da lohtn wohl ein Upgrade auf 8/9 :)

Danke für die vielen Infos. Habe bis inkl. gsatus schon in meine Doku übernommen - ggf. Teste ich das heut Abend noch. Muss jetzt allerdings erstmal los.

@apollon77 sagte in iobroker hochverfügbar:

Dann viel Spass beim experimentieren und wäre cool am Ende eine Anleitung zu haben :-))

Selbstverständlich, ich schreibe Schritt für Schritt mit - da kommt die automatisch bei raus. Ggf. muss man doch noch etwas Hintergrundwissen verlinken / formulieren. Grundsätzlich sollte sich das dann auch auf ein 3-NUC ++ Setup adaptieren lassen.

- nach aufsetzen des glusterfs volumes noch ein

-

Hallo zusammen, passend zum Thema gibts es hier eine Dokumentation eines kompletten HA Setups: https://forum.iobroker.net/topic/47478/dokumentation-einer-proxmox-iobroker-redis-ha-umgebung

-

Hi

Ich weiß der Thread ist schon alt, jedoch befasse ich mich gerade auch mit dem Thema.

Gibt es mitlerweile was neues oder einen neuen Thread den ich übesehen habe?@sufra Ich denke es gibt so 2-3 Threads zum Thema, aber noch keine vollständige Lösung.

Mit Objekten und States im Redis und einem Redis-Multihost setup mit Sentinel im Hintergrund bist Du schonmal unabhängig vom Filesystem.Ich glaube die meisten nutzen aktuell dann eher Proxmox als Cluster mit 2+Quorum oder 3 Nodes mit Shared Filesystem und damit werden beim ausfall eines nodes die VMs bzw container automatisch umverteilt.

Die HA Pläne sind immer noch auf Todo listen, aber bisher gabs immer wichtigere Baustellen.

-

Ich habe mir nun 3 NUCs zugelegt.

Proxmox ist installiert.

Cluster ist erstellt.Nun komme ich bei GlusterFS nicht weiter.

Kann ich hier Fragen dazu stellen oder soll ich einen neuen Thread aufmachen?

Ich habe auch das tolle Tutial von Thorsten und würde mich dann dort auch einbringen wollen. -

Ich habe mir nun 3 NUCs zugelegt.

Proxmox ist installiert.

Cluster ist erstellt.Nun komme ich bei GlusterFS nicht weiter.

Kann ich hier Fragen dazu stellen oder soll ich einen neuen Thread aufmachen?

Ich habe auch das tolle Tutial von Thorsten und würde mich dann dort auch einbringen wollen.@sufra

Auf der iob Seite gibt es eine super Doku.

Mit der kann nichts schief gehen.Bist du nach dieser vorgegangen ?

Wenn nein, warum nicht ?

Wenn ja, an welchem Punkt hakt es da ? -

Zur GlusterFS installation habe ich in der IOBroker Doku nichts gefunden...

Zu IOBroker an sich habe ich auch keine Fragen, habe einen Server schon seit Jahren in Betrieb.@sufra sagte in iobroker hochverfügbar:

Zur GlusterFS installation habe ich in der IOBroker Doku nichts gefunden...

gibt es auch nichts, das sprengt den Rahmen, da es mit iobroker nichts zu tun hat

solch Fragen sind dann besser im Proxmox Forum zu stellen

-

Okay ich Frag einfach mal ;)

Meine SSD ist wie folgt partioniert:

root@pve-node1:~# lsblk NAME MAJ:MIN RM SIZE RO TYPE MOUNTPOINT nvme0n1 259:0 0 465.8G 0 disk ├─nvme0n1p1 259:1 0 1007K 0 part ├─nvme0n1p2 259:2 0 1G 0 part /boot/efi └─nvme0n1p3 259:3 0 464.8G 0 part ├─pve-swap 253:0 0 8G 0 lvm [SWAP] └─pve-root 253:1 0 20G 0 lvm /Kann man und wenn ja wie in der Partition

nvme0n1p3GlusterFS installieren? -

@sufra sagte in iobroker hochverfügbar:

Nun komme ich bei GlusterFS nicht weiter.

nimm cephfs..

ich war lange auf glusterfs... wie Apollon auch.. bin aber gewechselt.. da Proxmox hier eine direkte unterstüzung bietet

und du keine Nachteile dadurch hast -

Okay ich Frag einfach mal ;)

Meine SSD ist wie folgt partioniert:

root@pve-node1:~# lsblk NAME MAJ:MIN RM SIZE RO TYPE MOUNTPOINT nvme0n1 259:0 0 465.8G 0 disk ├─nvme0n1p1 259:1 0 1007K 0 part ├─nvme0n1p2 259:2 0 1G 0 part /boot/efi └─nvme0n1p3 259:3 0 464.8G 0 part ├─pve-swap 253:0 0 8G 0 lvm [SWAP] └─pve-root 253:1 0 20G 0 lvm /Kann man und wenn ja wie in der Partition

nvme0n1p3GlusterFS installieren?@sufra sagte in iobroker hochverfügbar:

Kann man und wenn ja wie in der Partition nvme0n1p3 GlusterFS installieren?

Ja, müsste auch aus meiner Doku zu lesen sein. Musst mal schauen, die Befehle halt entsprechend abwandeln.

@arteck sagte in iobroker hochverfügbar:

nimm cephfs..

ich war lange auf glusterfs... wie Apollon auch.. bin aber gewechselt.. da Proxmox hier eine direkte unterstüzung bietet

und du keine Nachteile dadurch hastBin zwischenzeitlich sogar wieder zurück auf einen Node ;)

-

@sufra sagte in iobroker hochverfügbar:

Kann man und wenn ja wie in der Partition nvme0n1p3 GlusterFS installieren?

Ja, müsste auch aus meiner Doku zu lesen sein. Musst mal schauen, die Befehle halt entsprechend abwandeln.

@arteck sagte in iobroker hochverfügbar:

nimm cephfs..

ich war lange auf glusterfs... wie Apollon auch.. bin aber gewechselt.. da Proxmox hier eine direkte unterstüzung bietet

und du keine Nachteile dadurch hastBin zwischenzeitlich sogar wieder zurück auf einen Node ;)

-

@sufra sagte in iobroker hochverfügbar:

Kann man und wenn ja wie in der Partition nvme0n1p3 GlusterFS installieren?

Ja, müsste auch aus meiner Doku zu lesen sein. Musst mal schauen, die Befehle halt entsprechend abwandeln.

@arteck sagte in iobroker hochverfügbar:

nimm cephfs..

ich war lange auf glusterfs... wie Apollon auch.. bin aber gewechselt.. da Proxmox hier eine direkte unterstüzung bietet

und du keine Nachteile dadurch hastBin zwischenzeitlich sogar wieder zurück auf einen Node ;)

@darkiop Hi

Darf ich dein Projekt, "Proxmox-ioBroker-Redis-HA Doku: https://forum.iobroker.net/topic/47478/dokumentation-einer-proxmox-iobroker-redis-ha-umgebung" weiter führen?Ich habe mitlerweile GlusterFS auf meinen Nodes installiert und bin mit meinem Server aufs Cluster umgezogen.

Deine Anleitung war mir eine große Hilfe, vielen Dank dafür.

Einiges muss jedoch bei einer Installation in einem realen System anders gemacht werden.

Ich würde das gerne in deiner Anleitung ändern bzw ergänzen.Wenn du nichts dagegen hast würde ich die Abschnitte für die erstellung der virtuellen Nodes entfernen.

-

@darkiop Hi

Darf ich dein Projekt, "Proxmox-ioBroker-Redis-HA Doku: https://forum.iobroker.net/topic/47478/dokumentation-einer-proxmox-iobroker-redis-ha-umgebung" weiter führen?Ich habe mitlerweile GlusterFS auf meinen Nodes installiert und bin mit meinem Server aufs Cluster umgezogen.

Deine Anleitung war mir eine große Hilfe, vielen Dank dafür.

Einiges muss jedoch bei einer Installation in einem realen System anders gemacht werden.

Ich würde das gerne in deiner Anleitung ändern bzw ergänzen.Wenn du nichts dagegen hast würde ich die Abschnitte für die erstellung der virtuellen Nodes entfernen.

Hi Sufra, grad gesehen das du auch eine PM gesendet hattest ;) Das geht gerne mal unter. Sorry :D

Ja klar, darfst gerne ergänzen/ändern. Die Anleitung ist damals erst auf einer virtuellen Umgebung (3x/2x Proxmox in einer VM und später dann 2x NUCs + 1x RPI) entstanden. Daher die Vermischung. Zur Korrektur bin ich dann nicht mehr gekommen. Wenn für dich OK, kannst du das nach deiner Arbeit auch gerne als PR einstellen.

Bin zurück auf einen Node, da ich 1. etwas das Grundrauschen an Stromverbrauch senken wollte (auch wenn da ein Großteil locker durch durch die PV gedeckt ist) und 2. weil ich etwas komplexität rausnehmen wollte. Bin aktuell viel unterwegs und gefühlt läuft das Single-Node System stabiler (wie gesagt, nur ein Gefühl, belegen kann ich es nicht :)).

-

Ich habe mir nun 3 NUCs zugelegt.

Proxmox ist installiert.

Cluster ist erstellt.Nun komme ich bei GlusterFS nicht weiter.

Kann ich hier Fragen dazu stellen oder soll ich einen neuen Thread aufmachen?

Ich habe auch das tolle Tutial von Thorsten und würde mich dann dort auch einbringen wollen.

Hey! Du scheinst an dieser Unterhaltung interessiert zu sein, hast aber noch kein Konto.

Hast du es satt, bei jedem Besuch durch die gleichen Beiträge zu scrollen? Wenn du dich für ein Konto anmeldest, kommst du immer genau dorthin zurück, wo du zuvor warst, und kannst dich über neue Antworten benachrichtigen lassen (entweder per E-Mail oder Push-Benachrichtigung). Du kannst auch Lesezeichen speichern und Beiträge positiv bewerten, um anderen Community-Mitgliedern deine Wertschätzung zu zeigen.

Mit deinem Input könnte dieser Beitrag noch besser werden 💗

Registrieren Anmelden