NEWS

Gelegentliche Verbindungsabbrüche (zigbee, telegram, wled)

-

Hallo,

ich bin von zwei USB Zigbee Sticks auf zwei LAN Zigbee Sticks umgestiegen. Seitdem hab ich gemerkt das man Netzwerk wohl ab und zu irgendwo ein "Schluckauf" hat (war wohl vorher auch schon). Ich habe festgestellt das ca. 3-5 mal pro Woche folgender Error bei Zigbee.0 oder Zigbee.1 kommt.

zigbee.0 2021-11-13 12:16:34.402 error Adapter disconnected, stoppingDaraufhin lasse ich die Instanz zigbee.0 (oder zigebee.1) neustarten und ca. 4 Sekunden später ist die Instanz wieder grün.

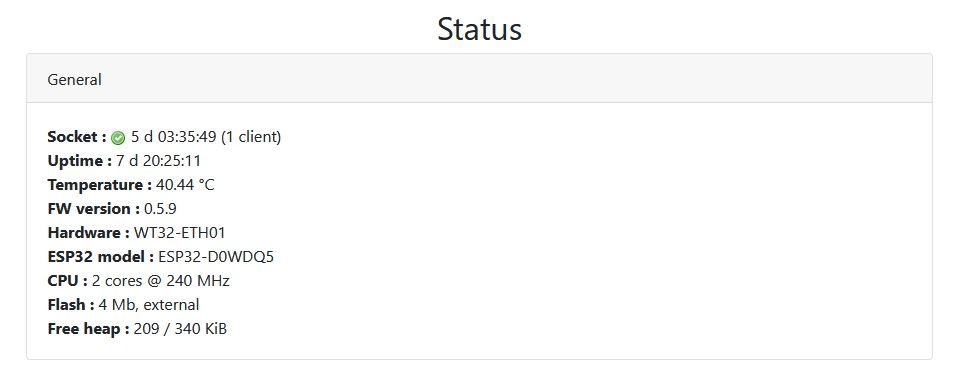

Im Status vom LAN zigbee Stick sieht man in der uptime, dass dieser nicht neugestartet hat und so. Also schließe ich daraus das es ein Netzwerkproblem ist. Da sehr sehr oft bzw. fast immer auch gleichzeitig reconnect Error von wled und telegram im log sind.

telegram.1 2021-11-13 12:16:38.051 error getMe (reconnect #0) Error:Error: EFATAL: Error: getaddrinfo EAI_AGAIN api.telegram.org telegram.2 2021-11-13 12:16:37.844 error getMe (reconnect #0) Error:Error: EFATAL: Error: getaddrinfo EAI_AGAIN api.telegram.org zigbee.0 2021-11-13 12:16:34.544 warn Failed to stop zigbee during startup zigbee.0 2021-11-13 12:16:34.402 error Adapter disconnected, stopping wled.0 2021-11-13 12:16:33.357 warn Device 192.168.178.185 offline, will try to reconnectIn meinem Netzwerk verwende ich ausschließlich unifi switche. Iobroker läuft auf einem NUC mit proxmox. Leider nutzte ich im Moment noch powerline, könnte dass das Problem sein? Oder habt ihr eine Idee wie ich es noch weiter eingrenzen kann? Verbindungsprobleme von der iobroker webUI oder VIS kann ich keine feststellen. Sonst habe ich auch keine Netzwerkprobleme die ich irgendwie feststellen kann.

-

Hallo,

ich bin von zwei USB Zigbee Sticks auf zwei LAN Zigbee Sticks umgestiegen. Seitdem hab ich gemerkt das man Netzwerk wohl ab und zu irgendwo ein "Schluckauf" hat (war wohl vorher auch schon). Ich habe festgestellt das ca. 3-5 mal pro Woche folgender Error bei Zigbee.0 oder Zigbee.1 kommt.

zigbee.0 2021-11-13 12:16:34.402 error Adapter disconnected, stoppingDaraufhin lasse ich die Instanz zigbee.0 (oder zigebee.1) neustarten und ca. 4 Sekunden später ist die Instanz wieder grün.

Im Status vom LAN zigbee Stick sieht man in der uptime, dass dieser nicht neugestartet hat und so. Also schließe ich daraus das es ein Netzwerkproblem ist. Da sehr sehr oft bzw. fast immer auch gleichzeitig reconnect Error von wled und telegram im log sind.

telegram.1 2021-11-13 12:16:38.051 error getMe (reconnect #0) Error:Error: EFATAL: Error: getaddrinfo EAI_AGAIN api.telegram.org telegram.2 2021-11-13 12:16:37.844 error getMe (reconnect #0) Error:Error: EFATAL: Error: getaddrinfo EAI_AGAIN api.telegram.org zigbee.0 2021-11-13 12:16:34.544 warn Failed to stop zigbee during startup zigbee.0 2021-11-13 12:16:34.402 error Adapter disconnected, stopping wled.0 2021-11-13 12:16:33.357 warn Device 192.168.178.185 offline, will try to reconnectIn meinem Netzwerk verwende ich ausschließlich unifi switche. Iobroker läuft auf einem NUC mit proxmox. Leider nutzte ich im Moment noch powerline, könnte dass das Problem sein? Oder habt ihr eine Idee wie ich es noch weiter eingrenzen kann? Verbindungsprobleme von der iobroker webUI oder VIS kann ich keine feststellen. Sonst habe ich auch keine Netzwerkprobleme die ich irgendwie feststellen kann.

@saeft_2003

Was sagt der unifi Controller?In letzter Zeit läuft das unifi Netzwerk auch bei mir nicht unauffällig. Die Verbindungen sind zwar soweit stabil, jedoch haben einige Switches angeblich keine Geräte angeschlossen. Die Ports werden witzigerweise mit den richtigen Indikatoren für Geschwindigkeiten angezeigt. Nach einem Neustart passt die Anzeige für ein paar Minuten.

Bei den weißen Mini Switches (5 Fach) läuft autonegation nicht zuverlässig. Oft wird statt 1GB nur mit 100 MB verbunden.

Mit anderen Worten: automatische Updates schalte ich ab, sobald wieder alles rund läuft.

Zum Thema nochmal: ich nutze rs485 über Netzwerk. Gelegentlich startet Node Red die Verbindung neu. Möglich, dass da Latenzen teilweise zu hoch sind. Die Netzwerk-Verbindungen bleiben erhalten.

-

@saeft_2003

Was sagt der unifi Controller?In letzter Zeit läuft das unifi Netzwerk auch bei mir nicht unauffällig. Die Verbindungen sind zwar soweit stabil, jedoch haben einige Switches angeblich keine Geräte angeschlossen. Die Ports werden witzigerweise mit den richtigen Indikatoren für Geschwindigkeiten angezeigt. Nach einem Neustart passt die Anzeige für ein paar Minuten.

Bei den weißen Mini Switches (5 Fach) läuft autonegation nicht zuverlässig. Oft wird statt 1GB nur mit 100 MB verbunden.

Mit anderen Worten: automatische Updates schalte ich ab, sobald wieder alles rund läuft.

Zum Thema nochmal: ich nutze rs485 über Netzwerk. Gelegentlich startet Node Red die Verbindung neu. Möglich, dass da Latenzen teilweise zu hoch sind. Die Netzwerk-Verbindungen bleiben erhalten.

Bei welchem Gerät soll ich den im unifi Controller schauen?

-

Bei welchem Gerät soll ich den im unifi Controller schauen?

@saeft_2003

Ich würde mit dem Meldungen (das Glockensymbol) anfangen.

Im Dashboard werden z.B. hohe Latenzen vermerkt. -

@saeft_2003

Ich würde mit dem Meldungen (das Glockensymbol) anfangen.

Im Dashboard werden z.B. hohe Latenzen vermerkt.Also Meldungen bei der Glocke gibt es keine. Hohe Latenzen gibt es aber nur bei den WLAN Geräten und davon sind 90% Sonoffs…

-

Also Meldungen bei der Glocke gibt es keine. Hohe Latenzen gibt es aber nur bei den WLAN Geräten und davon sind 90% Sonoffs…

@saeft_2003

ich würde mal den Ping-Adapter auf den Zigbee-Stick loslassen. Also die Pings einen Zeitraum lang mitloggen. Evtl. erkennst Du da was.

Mit PowerLAN fehlt mir die Erfahrung. Ein Versuch vor ein paar Jahren brachte bei mir nur ein paar Kilobits pro Sekunde, so dass ich das gleich wieder verworfen hatte. -

Hallo,

ich bin von zwei USB Zigbee Sticks auf zwei LAN Zigbee Sticks umgestiegen. Seitdem hab ich gemerkt das man Netzwerk wohl ab und zu irgendwo ein "Schluckauf" hat (war wohl vorher auch schon). Ich habe festgestellt das ca. 3-5 mal pro Woche folgender Error bei Zigbee.0 oder Zigbee.1 kommt.

zigbee.0 2021-11-13 12:16:34.402 error Adapter disconnected, stoppingDaraufhin lasse ich die Instanz zigbee.0 (oder zigebee.1) neustarten und ca. 4 Sekunden später ist die Instanz wieder grün.

Im Status vom LAN zigbee Stick sieht man in der uptime, dass dieser nicht neugestartet hat und so. Also schließe ich daraus das es ein Netzwerkproblem ist. Da sehr sehr oft bzw. fast immer auch gleichzeitig reconnect Error von wled und telegram im log sind.

telegram.1 2021-11-13 12:16:38.051 error getMe (reconnect #0) Error:Error: EFATAL: Error: getaddrinfo EAI_AGAIN api.telegram.org telegram.2 2021-11-13 12:16:37.844 error getMe (reconnect #0) Error:Error: EFATAL: Error: getaddrinfo EAI_AGAIN api.telegram.org zigbee.0 2021-11-13 12:16:34.544 warn Failed to stop zigbee during startup zigbee.0 2021-11-13 12:16:34.402 error Adapter disconnected, stopping wled.0 2021-11-13 12:16:33.357 warn Device 192.168.178.185 offline, will try to reconnectIn meinem Netzwerk verwende ich ausschließlich unifi switche. Iobroker läuft auf einem NUC mit proxmox. Leider nutzte ich im Moment noch powerline, könnte dass das Problem sein? Oder habt ihr eine Idee wie ich es noch weiter eingrenzen kann? Verbindungsprobleme von der iobroker webUI oder VIS kann ich keine feststellen. Sonst habe ich auch keine Netzwerkprobleme die ich irgendwie feststellen kann.

@saeft_2003 sagte in Gelegentliche Verbindungsabbrüche (zigbee, telegram, wled):

In meinem Netzwerk verwende ich ausschließlich unifi switche

vllt liegt es auch an der Firmeware oder der Controller version, gab die Tage ja genug updates, bei mir lief es vor kurzem auch nicht ganz rund.

habe auch seit paar Tagen immer mal "Aussetzer" zumindest laut Proxmox Oberfläche

-

@saeft_2003 sagte in Gelegentliche Verbindungsabbrüche (zigbee, telegram, wled):

In meinem Netzwerk verwende ich ausschließlich unifi switche

vllt liegt es auch an der Firmeware oder der Controller version, gab die Tage ja genug updates, bei mir lief es vor kurzem auch nicht ganz rund.

habe auch seit paar Tagen immer mal "Aussetzer" zumindest laut Proxmox Oberfläche

in proxmox sind bei mir keine Aussetzer ersichtlich.

-

@saeft_2003 sagte in Gelegentliche Verbindungsabbrüche (zigbee, telegram, wled):

In meinem Netzwerk verwende ich ausschließlich unifi switche

vllt liegt es auch an der Firmeware oder der Controller version, gab die Tage ja genug updates, bei mir lief es vor kurzem auch nicht ganz rund.

habe auch seit paar Tagen immer mal "Aussetzer" zumindest laut Proxmox Oberfläche

ich hoffe du kannst mir evtl weiter helfen. Ich habe mein iobroker jetzt alles aktuell (bullseye, node 14, usw..). Auch proxmox ist up to date. Trotzdem habe ich noch die Verbindungsabbrüche.

Ich gehe davon aus das es an proxmox liegt, immer wenn es ein Abbruch gab, sind ganz viele kernel Einträge im syslog von proxmox. Leider kann ich diese nicht "lesen" bzw. weis nicht was diese bedeuten. Kannst du mir dabei helfen?

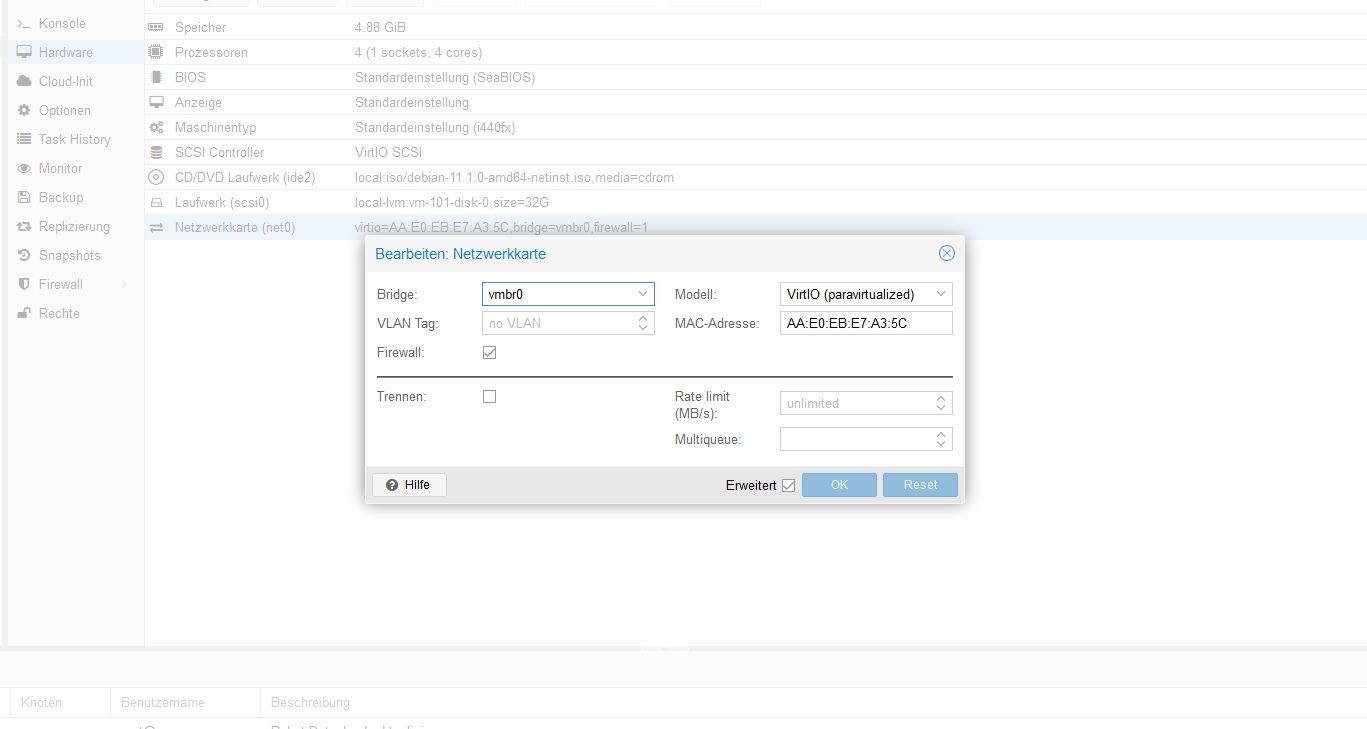

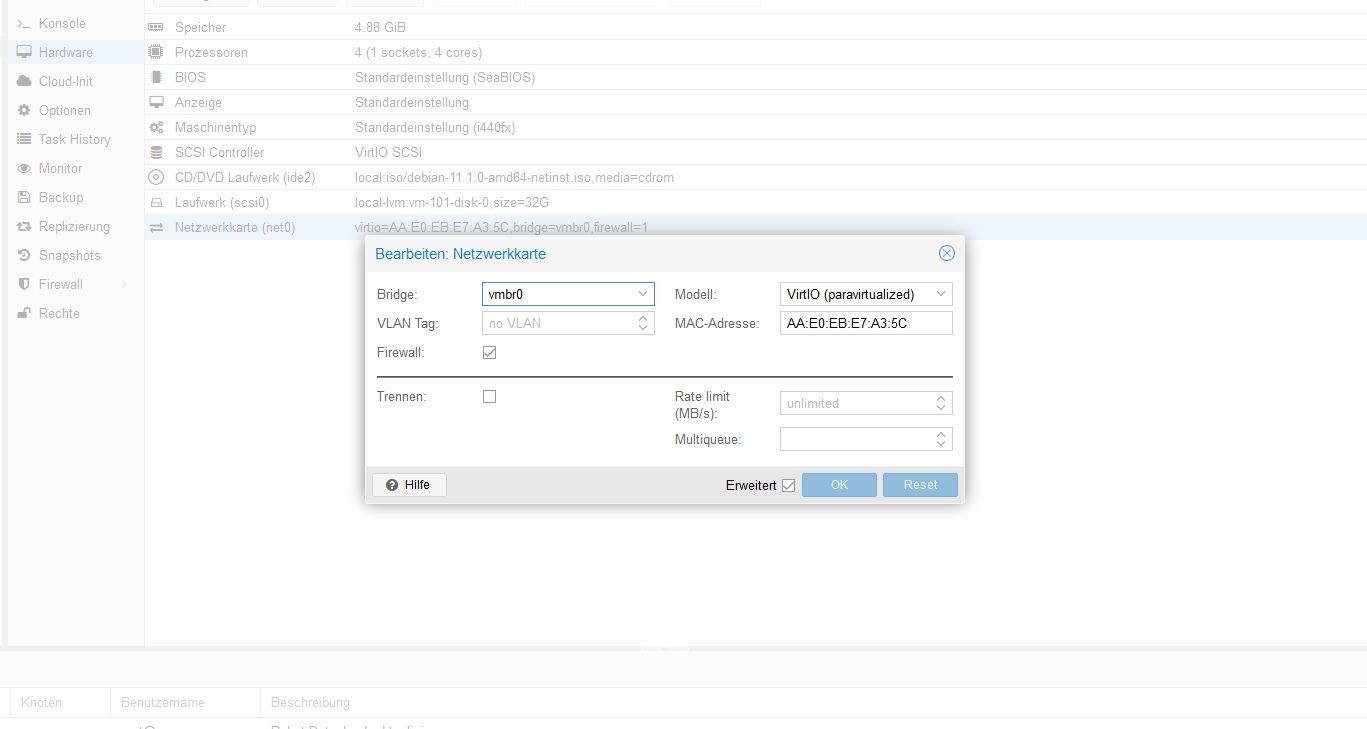

Dec 1 16:20:35 pve systemd[1]: Started User Manager for UID 0. Dec 1 16:20:35 pve systemd[1]: Started Session 648567 of user root. Dec 1 16:20:35 pve systemd[1]: session-648567.scope: Succeeded. Dec 1 16:20:46 pve systemd[1]: Stopping User Manager for UID 0... Dec 1 16:20:46 pve systemd[5008]: Stopped target Default. Dec 1 16:20:46 pve systemd[5008]: Stopped target Basic System. Dec 1 16:20:46 pve systemd[5008]: Stopped target Sockets. Dec 1 16:20:46 pve systemd[5008]: gpg-agent-browser.socket: Succeeded. Dec 1 16:20:46 pve systemd[5008]: Closed GnuPG cryptographic agent and passphrase cache (access for web browsers). Dec 1 16:20:46 pve systemd[5008]: gpg-agent-extra.socket: Succeeded. Dec 1 16:20:46 pve systemd[5008]: Closed GnuPG cryptographic agent and passphrase cache (restricted). Dec 1 16:20:46 pve systemd[5008]: gpg-agent-ssh.socket: Succeeded. Dec 1 16:20:46 pve systemd[5008]: Closed GnuPG cryptographic agent (ssh-agent emulation). Dec 1 16:20:46 pve systemd[5008]: gpg-agent.socket: Succeeded. Dec 1 16:20:46 pve systemd[5008]: Closed GnuPG cryptographic agent and passphrase cache. Dec 1 16:20:46 pve systemd[5008]: Stopped target Paths. Dec 1 16:20:46 pve systemd[5008]: dirmngr.socket: Succeeded. Dec 1 16:20:46 pve systemd[5008]: Closed GnuPG network certificate management daemon. Dec 1 16:20:46 pve systemd[5008]: Reached target Shutdown. Dec 1 16:20:46 pve systemd[5008]: systemd-exit.service: Succeeded. Dec 1 16:20:46 pve systemd[5008]: Started Exit the Session. Dec 1 16:20:46 pve systemd[5008]: Reached target Exit the Session. Dec 1 16:20:46 pve systemd[5008]: Stopped target Timers. Dec 1 16:20:46 pve systemd[1]: user@0.service: Succeeded. Dec 1 16:20:46 pve systemd[1]: Stopped User Manager for UID 0. Dec 1 16:20:46 pve systemd[1]: Stopping User Runtime Directory /run/user/0... Dec 1 16:20:46 pve systemd[1]: run-user-0.mount: Succeeded. Dec 1 16:20:46 pve systemd[1]: user-runtime-dir@0.service: Succeeded. Dec 1 16:20:46 pve systemd[1]: Stopped User Runtime Directory /run/user/0. Dec 1 16:20:46 pve systemd[1]: Removed slice User Slice of UID 0. Dec 1 16:20:46 pve kernel: [15727012.768691] e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: Dec 1 16:20:46 pve kernel: [15727012.768691] TDH <f7> Dec 1 16:20:46 pve kernel: [15727012.768691] TDT <36> Dec 1 16:20:46 pve kernel: [15727012.768691] next_to_use <36> Dec 1 16:20:46 pve kernel: [15727012.768691] next_to_clean <f6> Dec 1 16:20:46 pve kernel: [15727012.768691] buffer_info[next_to_clean]: Dec 1 16:20:46 pve kernel: [15727012.768691] time_stamp <1ea5956cb> Dec 1 16:20:46 pve kernel: [15727012.768691] next_to_watch <f7> Dec 1 16:20:46 pve kernel: [15727012.768691] jiffies <1ea5958b1> Dec 1 16:20:46 pve kernel: [15727012.768691] next_to_watch.status <0> Dec 1 16:20:46 pve kernel: [15727012.768691] MAC Status <40080083> Dec 1 16:20:46 pve kernel: [15727012.768691] PHY Status <796d> Dec 1 16:20:46 pve kernel: [15727012.768691] PHY 1000BASE-T Status <3800> Dec 1 16:20:46 pve kernel: [15727012.768691] PHY Extended Status <3000> Dec 1 16:20:46 pve kernel: [15727012.768691] PCI Status <10> Dec 1 16:20:48 pve kernel: [15727014.784669] e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: Dec 1 16:20:48 pve kernel: [15727014.784669] TDH <f7> Dec 1 16:20:48 pve kernel: [15727014.784669] TDT <36> Dec 1 16:20:48 pve kernel: [15727014.784669] next_to_use <36> Dec 1 16:20:48 pve kernel: [15727014.784669] next_to_clean <f6> Dec 1 16:20:48 pve kernel: [15727014.784669] buffer_info[next_to_clean]: Dec 1 16:20:48 pve kernel: [15727014.784669] time_stamp <1ea5956cb> Dec 1 16:20:48 pve kernel: [15727014.784669] next_to_watch <f7> Dec 1 16:20:48 pve kernel: [15727014.784669] jiffies <1ea595aa9> Dec 1 16:20:48 pve kernel: [15727014.784669] next_to_watch.status <0> Dec 1 16:20:48 pve kernel: [15727014.784669] MAC Status <40080083> Dec 1 16:20:48 pve kernel: [15727014.784669] PHY Status <796d> Dec 1 16:20:48 pve kernel: [15727014.784669] PHY 1000BASE-T Status <3800> Dec 1 16:20:48 pve kernel: [15727014.784669] PHY Extended Status <3000> Dec 1 16:20:48 pve kernel: [15727014.784669] PCI Status <10> Dec 1 16:20:50 pve kernel: [15727016.768716] e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: Dec 1 16:20:50 pve kernel: [15727016.768716] TDH <f7> Dec 1 16:20:50 pve kernel: [15727016.768716] TDT <36> Dec 1 16:20:50 pve kernel: [15727016.768716] next_to_use <36> Dec 1 16:20:50 pve kernel: [15727016.768716] next_to_clean <f6> Dec 1 16:20:50 pve kernel: [15727016.768716] buffer_info[next_to_clean]: Dec 1 16:20:50 pve kernel: [15727016.768716] time_stamp <1ea5956cb> Dec 1 16:20:50 pve kernel: [15727016.768716] next_to_watch <f7> Dec 1 16:20:50 pve kernel: [15727016.768716] jiffies <1ea595c99> Dec 1 16:20:50 pve kernel: [15727016.768716] next_to_watch.status <0> Dec 1 16:20:50 pve kernel: [15727016.768716] MAC Status <40080083> Dec 1 16:20:50 pve kernel: [15727016.768716] PHY Status <796d> Dec 1 16:20:50 pve kernel: [15727016.768716] PHY 1000BASE-T Status <3800> Dec 1 16:20:50 pve kernel: [15727016.768716] PHY Extended Status <3000> Dec 1 16:20:50 pve kernel: [15727016.768716] PCI Status <10> Dec 1 16:20:52 pve kernel: [15727018.780704] e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: Dec 1 16:20:52 pve kernel: [15727018.780704] TDH <f7> Dec 1 16:20:52 pve kernel: [15727018.780704] TDT <36> Dec 1 16:20:52 pve kernel: [15727018.780704] next_to_use <36> Dec 1 16:20:52 pve kernel: [15727018.780704] next_to_clean <f6> Dec 1 16:20:52 pve kernel: [15727018.780704] buffer_info[next_to_clean]: Dec 1 16:20:52 pve kernel: [15727018.780704] time_stamp <1ea5956cb> Dec 1 16:20:52 pve kernel: [15727018.780704] next_to_watch <f7> Dec 1 16:20:52 pve kernel: [15727018.780704] jiffies <1ea595e90> Dec 1 16:20:52 pve kernel: [15727018.780704] next_to_watch.status <0> Dec 1 16:20:52 pve kernel: [15727018.780704] MAC Status <40080083> Dec 1 16:20:52 pve kernel: [15727018.780704] PHY Status <796d> Dec 1 16:20:52 pve kernel: [15727018.780704] PHY 1000BASE-T Status <3800> Dec 1 16:20:52 pve kernel: [15727018.780704] PHY Extended Status <3000> Dec 1 16:20:52 pve kernel: [15727018.780704] PCI Status <10> Dec 1 16:20:53 pve kernel: [15727019.996459] e1000e 0000:00:1f.6 eno1: Reset adapter unexpectedly Dec 1 16:20:54 pve kernel: [15727020.086074] vmbr0: port 1(eno1) entered disabled state Dec 1 16:20:59 pve kernel: [15727025.704797] e1000e: eno1 NIC Link is Up 1000 Mbps Full Duplex, Flow Control: None Dec 1 16:20:59 pve kernel: [15727025.704874] vmbr0: port 1(eno1) entered blocking state Dec 1 16:20:59 pve kernel: [15727025.704879] vmbr0: port 1(eno1) entered forwarding state Dec 1 16:21:00 pve systemd[1]: Starting Proxmox VE replication runner... Dec 1 16:21:01 pve systemd[1]: pvesr.service: Succeeded. Dec 1 16:21:01 pve systemd[1]: Started Proxmox VE replication runner. Dec 1 16:21:03 pve pvestatd[972]: storage 'Diskstation' is not online Dec 1 16:21:03 pve pvestatd[972]: status update time (10.198 seconds) Dec 1 16:21:36 pve systemd[1]: Starting Cleanup of Temporary Directories... Dec 1 16:21:36 pve systemd[1]: Created slice User Slice of UID 0. Dec 1 16:21:36 pve systemd[1]: Starting User Runtime Directory /run/user/0... Dec 1 16:21:36 pve systemd[1]: Started User Runtime Directory /run/user/0. Dec 1 16:21:36 pve systemd[1]: Starting User Manager for UID 0... Dec 1 16:21:36 pve systemd[1]: systemd-tmpfiles-clean.service: Succeeded. Dec 1 16:21:36 pve systemd[1]: Started Cleanup of Temporary Directories. Dec 1 16:21:36 pve systemd[5262]: Reached target Paths. Dec 1 16:21:36 pve systemd[5262]: Listening on GnuPG cryptographic agent and passphrase cache. Dec 1 16:21:36 pve systemd[5262]: Listening on GnuPG network certificate management daemon. Dec 1 16:21:36 pve systemd[5262]: Listening on GnuPG cryptographic agent (ssh-agent emulation). Dec 1 16:21:36 pve systemd[5262]: Reached target Timers. Dec 1 16:21:36 pve systemd[5262]: Listening on GnuPG cryptographic agent and passphrase cache (access for web browsers). Dec 1 16:21:36 pve systemd[5262]: Listening on GnuPG cryptographic agent and passphrase cache (restricted). Dec 1 16:21:36 pve systemd[5262]: Reached target Sockets. Dec 1 16:21:36 pve systemd[5262]: Reached target Basic System. Dec 1 16:21:36 pve systemd[5262]: Reached target Default.Dec 3 18:05:59 pve systemd[1]: user@0.service: Succeeded. Dec 3 18:05:59 pve systemd[1]: Stopped User Manager for UID 0. Dec 3 18:05:59 pve systemd[1]: Stopping User Runtime Directory /run/user/0... Dec 3 18:05:59 pve systemd[1]: run-user-0.mount: Succeeded. Dec 3 18:05:59 pve systemd[1]: user-runtime-dir@0.service: Succeeded. Dec 3 18:05:59 pve systemd[1]: Stopped User Runtime Directory /run/user/0. Dec 3 18:05:59 pve systemd[1]: Removed slice User Slice of UID 0. Dec 3 18:06:00 pve systemd[1]: Starting Proxmox VE replication runner... Dec 3 18:06:01 pve systemd[1]: pvesr.service: Succeeded. Dec 3 18:06:01 pve systemd[1]: Started Proxmox VE replication runner. Dec 3 18:06:04 pve kernel: [73500.804549] e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: Dec 3 18:06:04 pve kernel: [73500.804549] TDH <70> Dec 3 18:06:04 pve kernel: [73500.804549] TDT <d2> Dec 3 18:06:04 pve kernel: [73500.804549] next_to_use <d2> Dec 3 18:06:04 pve kernel: [73500.804549] next_to_clean <6f> Dec 3 18:06:04 pve kernel: [73500.804549] buffer_info[next_to_clean]: Dec 3 18:06:04 pve kernel: [73500.804549] time_stamp <101173be6> Dec 3 18:06:04 pve kernel: [73500.804549] next_to_watch <70> Dec 3 18:06:04 pve kernel: [73500.804549] jiffies <101173e28> Dec 3 18:06:04 pve kernel: [73500.804549] next_to_watch.status <0> Dec 3 18:06:04 pve kernel: [73500.804549] MAC Status <40080083> Dec 3 18:06:04 pve kernel: [73500.804549] PHY Status <796d> Dec 3 18:06:04 pve kernel: [73500.804549] PHY 1000BASE-T Status <3800> Dec 3 18:06:04 pve kernel: [73500.804549] PHY Extended Status <3000> Dec 3 18:06:04 pve kernel: [73500.804549] PCI Status <10> Dec 3 18:06:06 pve kernel: [73502.788467] e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: Dec 3 18:06:06 pve kernel: [73502.788467] TDH <70> Dec 3 18:06:06 pve kernel: [73502.788467] TDT <d2> Dec 3 18:06:06 pve kernel: [73502.788467] next_to_use <d2> Dec 3 18:06:06 pve kernel: [73502.788467] next_to_clean <6f> Dec 3 18:06:06 pve kernel: [73502.788467] buffer_info[next_to_clean]: Dec 3 18:06:06 pve kernel: [73502.788467] time_stamp <101173be6> Dec 3 18:06:06 pve kernel: [73502.788467] next_to_watch <70> Dec 3 18:06:06 pve kernel: [73502.788467] jiffies <101174018> Dec 3 18:06:06 pve kernel: [73502.788467] next_to_watch.status <0> Dec 3 18:06:06 pve kernel: [73502.788467] MAC Status <40080083> Dec 3 18:06:06 pve kernel: [73502.788467] PHY Status <796d> Dec 3 18:06:06 pve kernel: [73502.788467] PHY 1000BASE-T Status <3800> Dec 3 18:06:06 pve kernel: [73502.788467] PHY Extended Status <3000> Dec 3 18:06:06 pve kernel: [73502.788467] PCI Status <10> Dec 3 18:06:08 pve kernel: [73504.804456] e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: Dec 3 18:06:08 pve kernel: [73504.804456] TDH <70> Dec 3 18:06:08 pve kernel: [73504.804456] TDT <d2> Dec 3 18:06:08 pve kernel: [73504.804456] next_to_use <d2> Dec 3 18:06:08 pve kernel: [73504.804456] next_to_clean <6f> Dec 3 18:06:08 pve kernel: [73504.804456] buffer_info[next_to_clean]: Dec 3 18:06:08 pve kernel: [73504.804456] time_stamp <101173be6> Dec 3 18:06:08 pve kernel: [73504.804456] next_to_watch <70> Dec 3 18:06:08 pve kernel: [73504.804456] jiffies <101174210> Dec 3 18:06:08 pve kernel: [73504.804456] next_to_watch.status <0> Dec 3 18:06:08 pve kernel: [73504.804456] MAC Status <40080083> Dec 3 18:06:08 pve kernel: [73504.804456] PHY Status <796d> Dec 3 18:06:08 pve kernel: [73504.804456] PHY 1000BASE-T Status <3800> Dec 3 18:06:08 pve kernel: [73504.804456] PHY Extended Status <3000> Dec 3 18:06:08 pve kernel: [73504.804456] PCI Status <10> Dec 3 18:06:09 pve kernel: [73506.020237] e1000e 0000:00:1f.6 eno1: Reset adapter unexpectedly Dec 3 18:06:10 pve kernel: [73506.109993] vmbr0: port 1(eno1) entered disabled state Dec 3 18:06:13 pve kernel: [73509.774753] e1000e: eno1 NIC Link is Up 1000 Mbps Full Duplex, Flow Control: None Dec 3 18:06:13 pve kernel: [73509.774832] vmbr0: port 1(eno1) entered blocking state Dec 3 18:06:13 pve kernel: [73509.774835] vmbr0: port 1(eno1) entered forwarding state Dec 3 18:06:19 pve pvestatd[1010]: status update time (7.290 seconds) Dec 3 18:06:49 pve systemd[1]: Created slice User Slice of UID 0. Dec 3 18:06:49 pve systemd[1]: Starting User Runtime Directory /run/user/0... Dec 3 18:06:49 pve systemd[1]: Started User Runtime Directory /run/user/0. Dec 3 18:06:49 pve systemd[1]: Starting User Manager for UID 0... Dec 3 18:06:49 pve systemd[16815]: Listening on GnuPG cryptographic agent and passphrase cache (access for web browsers). Dec 3 18:06:49 pve systemd[16815]: Listening on GnuPG network certificate management daemon. Dec 3 18:06:49 pve systemd[16815]: Listening on GnuPG cryptographic agent (ssh-agent emulation). Dec 3 18:06:49 pve systemd[16815]: Listening on GnuPG cryptographic agent and passphrase cache (restricted). Dec 3 18:06:49 pve systemd[16815]: Listening on GnuPG cryptographic agent and passphrase cache. Dec 3 18:06:49 pve systemd[16815]: Reached target Sockets. Dec 3 18:06:49 pve systemd[16815]: Reached target Paths. Dec 3 18:06:49 pve systemd[16815]: Reached target Timers. Dec 3 18:06:49 pve systemd[16815]: Reached target Basic System. Dec 3 18:06:49 pve systemd[16815]: Reached target Default. Dec 3 18:06:49 pve systemd[16815]: Startup finished in 30ms. Dec 3 18:06:49 pve systemd[1]: Started User Manager for UID 0.Dec 3 16:31:45 pve systemd[1]: user@0.service: Succeeded. Dec 3 16:31:45 pve systemd[1]: Stopped User Manager for UID 0. Dec 3 16:31:45 pve systemd[1]: Stopping User Runtime Directory /run/user/0... Dec 3 16:31:45 pve systemd[1]: run-user-0.mount: Succeeded. Dec 3 16:31:45 pve systemd[1]: user-runtime-dir@0.service: Succeeded. Dec 3 16:31:45 pve systemd[1]: Stopped User Runtime Directory /run/user/0. Dec 3 16:31:45 pve systemd[1]: Removed slice User Slice of UID 0. Dec 3 16:32:00 pve systemd[1]: Starting Proxmox VE replication runner... Dec 3 16:32:01 pve systemd[1]: pvesr.service: Succeeded. Dec 3 16:32:01 pve systemd[1]: Started Proxmox VE replication runner. Dec 3 16:32:04 pve kernel: [67860.869955] e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: Dec 3 16:32:04 pve kernel: [67860.869955] TDH <3> Dec 3 16:32:04 pve kernel: [67860.869955] TDT <16> Dec 3 16:32:04 pve kernel: [67860.869955] next_to_use <16> Dec 3 16:32:04 pve kernel: [67860.869955] next_to_clean <2> Dec 3 16:32:04 pve kernel: [67860.869955] buffer_info[next_to_clean]: Dec 3 16:32:04 pve kernel: [67860.869955] time_stamp <10101b77d> Dec 3 16:32:04 pve kernel: [67860.869955] next_to_watch <3> Dec 3 16:32:04 pve kernel: [67860.869955] jiffies <10101ba58> Dec 3 16:32:04 pve kernel: [67860.869955] next_to_watch.status <0> Dec 3 16:32:04 pve kernel: [67860.869955] MAC Status <40080083> Dec 3 16:32:04 pve kernel: [67860.869955] PHY Status <796d> Dec 3 16:32:04 pve kernel: [67860.869955] PHY 1000BASE-T Status <3800> Dec 3 16:32:04 pve kernel: [67860.869955] PHY Extended Status <3000> Dec 3 16:32:04 pve kernel: [67860.869955] PCI Status <10> Dec 3 16:32:06 pve kernel: [67862.885867] e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: Dec 3 16:32:06 pve kernel: [67862.885867] TDH <3> Dec 3 16:32:06 pve kernel: [67862.885867] TDT <16> Dec 3 16:32:06 pve kernel: [67862.885867] next_to_use <16> Dec 3 16:32:06 pve kernel: [67862.885867] next_to_clean <2> Dec 3 16:32:06 pve kernel: [67862.885867] buffer_info[next_to_clean]: Dec 3 16:32:06 pve kernel: [67862.885867] time_stamp <10101b77d> Dec 3 16:32:06 pve kernel: [67862.885867] next_to_watch <3> Dec 3 16:32:06 pve kernel: [67862.885867] jiffies <10101bc50> Dec 3 16:32:06 pve kernel: [67862.885867] next_to_watch.status <0> Dec 3 16:32:06 pve kernel: [67862.885867] MAC Status <40080083> Dec 3 16:32:06 pve kernel: [67862.885867] PHY Status <796d> Dec 3 16:32:06 pve kernel: [67862.885867] PHY 1000BASE-T Status <3800> Dec 3 16:32:06 pve kernel: [67862.885867] PHY Extended Status <3000> Dec 3 16:32:06 pve kernel: [67862.885867] PCI Status <10> Dec 3 16:32:08 pve kernel: [67864.873662] ------------[ cut here ]------------ Dec 3 16:32:08 pve kernel: [67864.873665] NETDEV WATCHDOG: eno1 (e1000e): transmit queue 0 timed out Dec 3 16:32:08 pve kernel: [67864.873679] WARNING: CPU: 0 PID: 0 at net/sched/sch_generic.c:473 dev_watchdog+0x264/0x270 Dec 3 16:32:08 pve kernel: [67864.873680] Modules linked in: dm_snapshot veth rpcsec_gss_krb5 auth_rpcgss nfsv4 nfs lockd grace fscache ebtable_filter ebtables ip_set ip6table_raw iptable_raw ip6table_filter ip6_tables iptable_filter bpfilter softdog nfnetlink_log nfnetlink snd_hda_codec_hdmi snd_hda_codec_realtek snd_hda_codec_generic snd_sof_pci snd_sof_intel_hda_common snd_soc_hdac_hda snd_sof_intel_hda snd_sof_intel_byt snd_sof_intel_ipc intel_rapl_msr snd_sof snd_sof_xtensa_dsp intel_rapl_common x86_pkg_temp_thermal intel_powerclamp snd_hda_ext_core snd_soc_acpi_intel_match snd_soc_acpi iwlmvm mei_hdcp ledtrig_audio coretemp btusb kvm_intel kvm irqbypass i915 mac80211 snd_soc_core btrtl crct10dif_pclmul libarc4 snd_compress btbcm btintel drm_kms_helper crc32_pclmul ac97_bus drm bluetooth i2c_algo_bit iwlwifi cp210x snd_pcm_dmaengine fb_sys_fops syscopyarea ghash_clmulni_intel ecdh_generic aesni_intel snd_hda_intel crypto_simd snd_intel_dspcfg snd_hda_codec snd_hda_core snd_hwdep cryptd snd_pcm glue_helper Dec 3 16:32:08 pve kernel: [67864.873714] snd_timer rapl snd mei_me intel_cstate pcspkr wmi_bmof intel_wmi_thunderbolt soundcore mei cdc_acm usbserial ecc cfg80211 sysfillrect sysimgblt mac_hid acpi_tad acpi_pad zfs(PO) zunicode(PO) zzstd(O) zlua(O) zavl(PO) icp(PO) zcommon(PO) znvpair(PO) spl(O) vhost_net vhost tap ib_iser rdma_cm iw_cm ib_cm ib_core iscsi_tcp libiscsi_tcp libiscsi scsi_transport_iscsi sunrpc ip_tables x_tables autofs4 btrfs xor zstd_compress raid6_pq dm_thin_pool dm_persistent_data dm_bio_prison dm_bufio libcrc32c hid_generic usbhid hid sdhci_pci cqhci sdhci e1000e i2c_i801 xhci_pci ahci thunderbolt intel_lpss_pci libahci intel_lpss idma64 xhci_hcd virt_dma wmi video pinctrl_cannonlake pinctrl_intel Dec 3 16:32:08 pve kernel: [67864.873733] CPU: 0 PID: 0 Comm: swapper/0 Tainted: P O 5.4.151-1-pve #1 Dec 3 16:32:08 pve kernel: [67864.873734] Hardware name: Intel(R) Client Systems NUC10i3FNH/NUC10i3FNB, BIOS FNCML357.0047.2020.1118.1629 11/18/2020 Dec 3 16:32:08 pve kernel: [67864.873735] RIP: 0010:dev_watchdog+0x264/0x270 Dec 3 16:32:08 pve kernel: [67864.873737] Code: 48 85 c0 75 e6 eb a0 4c 89 ef c6 05 22 86 ef 00 01 e8 60 b7 fa ff 89 d9 4c 89 ee 48 c7 c7 40 72 23 98 48 89 c2 e8 70 65 15 00 <0f> 0b eb 82 0f 1f 84 00 00 00 00 00 0f 1f 44 00 00 55 48 89 e5 41 Dec 3 16:32:08 pve kernel: [67864.873737] RSP: 0018:ffffa13580003e58 EFLAGS: 00010282 Dec 3 16:32:08 pve kernel: [67864.873738] RAX: 0000000000000000 RBX: 0000000000000000 RCX: 0000000000000006 Dec 3 16:32:08 pve kernel: [67864.873738] RDX: 0000000000000007 RSI: 0000000000000082 RDI: ffff91abf0c178c0 Dec 3 16:32:08 pve kernel: [67864.873739] RBP: ffffa13580003e88 R08: 000000000000047b R09: 0000000000000004 Dec 3 16:32:08 pve kernel: [67864.873739] R10: 0000000000000000 R11: 0000000000000001 R12: 0000000000000001 Dec 3 16:32:08 pve kernel: [67864.873739] R13: ffff91abe17d4000 R14: ffff91abe17d4480 R15: ffff91abe1787c80 Dec 3 16:32:08 pve kernel: [67864.873740] FS: 0000000000000000(0000) GS:ffff91abf0c00000(0000) knlGS:0000000000000000 Dec 3 16:32:08 pve kernel: [67864.873740] CS: 0010 DS: 0000 ES: 0000 CR0: 0000000080050033 Dec 3 16:32:08 pve kernel: [67864.873741] CR2: 00007ffccc3fdb88 CR3: 000000002160a006 CR4: 00000000003626f0 Dec 3 16:32:08 pve kernel: [67864.873741] Call Trace: Dec 3 16:32:08 pve kernel: [67864.873742] <IRQ> Dec 3 16:32:08 pve kernel: [67864.873745] ? pfifo_fast_enqueue+0x160/0x160 Dec 3 16:32:08 pve kernel: [67864.873747] call_timer_fn+0x32/0x130 Dec 3 16:32:08 pve kernel: [67864.873748] run_timer_softirq+0x1a5/0x430 Dec 3 16:32:08 pve kernel: [67864.873749] ? enqueue_hrtimer+0x3c/0x90 Dec 3 16:32:08 pve kernel: [67864.873750] ? ktime_get+0x3c/0xa0 Dec 3 16:32:08 pve kernel: [67864.873751] ? lapic_next_deadline+0x2c/0x40 Dec 3 16:32:08 pve kernel: [67864.873753] ? clockevents_program_event+0x93/0xf0 Dec 3 16:32:08 pve kernel: [67864.873755] __do_softirq+0xdc/0x2d4 Dec 3 16:32:08 pve kernel: [67864.873756] irq_exit+0xa9/0xb0 Dec 3 16:32:08 pve kernel: [67864.873757] smp_apic_timer_interrupt+0x79/0x130 Dec 3 16:32:08 pve kernel: [67864.873758] apic_timer_interrupt+0xf/0x20 Dec 3 16:32:08 pve kernel: [67864.873759] </IRQ> Dec 3 16:32:08 pve kernel: [67864.873761] RIP: 0010:cpuidle_enter_state+0xbd/0x450 Dec 3 16:32:08 pve kernel: [67864.873761] Code: ff e8 f7 41 88 ff 80 7d c7 00 74 17 9c 58 0f 1f 44 00 00 f6 c4 02 0f 85 63 03 00 00 31 ff e8 da 50 8e ff fb 66 0f 1f 44 00 00 <45> 85 ed 0f 88 8d 02 00 00 49 63 cd 48 8b 75 d0 48 2b 75 c8 48 8d Dec 3 16:32:08 pve kernel: [67864.873762] RSP: 0018:ffffffff98403de8 EFLAGS: 00000246 ORIG_RAX: ffffffffffffff13 Dec 3 16:32:08 pve kernel: [67864.873762] RAX: ffff91abf0c2ae40 RBX: ffffffff98557da0 RCX: 000000000000001f Dec 3 16:32:08 pve kernel: [67864.873763] RDX: 00003db905afd05c RSI: 000000003161faed RDI: 0000000000000000 Dec 3 16:32:08 pve kernel: [67864.873763] RBP: ffffffff98403e28 R08: 0000000000000002 R09: 000000000002a6c0 Dec 3 16:32:08 pve kernel: [67864.873764] R10: 0000a004ca71c794 R11: ffff91abf0c29ae0 R12: ffff91abf0c36c00 Dec 3 16:32:08 pve kernel: [67864.873764] R13: 0000000000000004 R14: ffffffff98557f38 R15: ffffffff98557f20 Dec 3 16:32:08 pve kernel: [67864.873766] ? cpuidle_enter_state+0x99/0x450 Dec 3 16:32:08 pve kernel: [67864.873767] cpuidle_enter+0x2e/0x40 Dec 3 16:32:08 pve kernel: [67864.873768] call_cpuidle+0x23/0x40 Dec 3 16:32:08 pve kernel: [67864.873769] do_idle+0x22c/0x270 Dec 3 16:32:08 pve kernel: [67864.873770] cpu_startup_entry+0x1d/0x20 Dec 3 16:32:08 pve kernel: [67864.873772] rest_init+0xae/0xb0 Dec 3 16:32:08 pve kernel: [67864.873773] arch_call_rest_init+0xe/0x1b Dec 3 16:32:08 pve kernel: [67864.873774] start_kernel+0x54c/0x56e Dec 3 16:32:08 pve kernel: [67864.873775] x86_64_start_reservations+0x24/0x26 Dec 3 16:32:08 pve kernel: [67864.873776] x86_64_start_kernel+0x74/0x77 Dec 3 16:32:08 pve kernel: [67864.873777] secondary_startup_64+0xa4/0xb0 Dec 3 16:32:08 pve kernel: [67864.873778] ---[ end trace 32f771dd5fd2b1f8 ]--- Dec 3 16:32:08 pve kernel: [67864.873793] e1000e 0000:00:1f.6 eno1: Reset adapter unexpectedly Dec 3 16:32:08 pve kernel: [67864.963212] vmbr0: port 1(eno1) entered disabled state Dec 3 16:32:12 pve kernel: [67868.620238] e1000e: eno1 NIC Link is Up 1000 Mbps Full Duplex, Flow Control: None Dec 3 16:32:12 pve kernel: [67868.620335] vmbr0: port 1(eno1) entered blocking state Dec 3 16:32:12 pve kernel: [67868.620338] vmbr0: port 1(eno1) entered forwarding state Dec 3 16:32:19 pve pvestatd[1010]: status update time (7.459 seconds) Dec 3 16:32:35 pve systemd[1]: Created slice User Slice of UID 0. Dec 3 16:32:35 pve systemd[1]: Starting User Runtime Directory /run/user/0... Dec 3 16:32:35 pve systemd[1]: Started User Runtime Directory /run/user/0. Dec 3 16:32:35 pve systemd[1]: Starting User Manager for UID 0... Dec 3 16:32:35 pve systemd[25320]: Listening on GnuPG cryptographic agent and passphrase cache. Dec 3 16:32:35 pve systemd[25320]: Listening on GnuPG cryptographic agent and passphrase cache (access for web browsers). Dec 3 16:32:35 pve systemd[25320]: Listening on GnuPG network certificate management daemon. Dec 3 16:32:35 pve systemd[25320]: Listening on GnuPG cryptographic agent (ssh-agent emulation). Dec 3 16:32:35 pve systemd[25320]: Listening on GnuPG cryptographic agent and passphrase cache (restricted). Dec 3 16:32:35 pve systemd[25320]: Reached target Sockets. Dec 3 16:32:35 pve systemd[25320]: Reached target Paths. Dec 3 16:32:35 pve systemd[25320]: Reached target Timers. Dec 3 16:32:35 pve systemd[25320]: Reached target Basic System. Dec 3 16:32:35 pve systemd[25320]: Reached target Default. Dec 3 16:32:35 pve systemd[25320]: Startup finished in 31ms. Dec 3 16:32:35 pve systemd[1]: Started User Manager for UID 0.Sind die Einstellungen richtig?

-

ich hoffe du kannst mir evtl weiter helfen. Ich habe mein iobroker jetzt alles aktuell (bullseye, node 14, usw..). Auch proxmox ist up to date. Trotzdem habe ich noch die Verbindungsabbrüche.

Ich gehe davon aus das es an proxmox liegt, immer wenn es ein Abbruch gab, sind ganz viele kernel Einträge im syslog von proxmox. Leider kann ich diese nicht "lesen" bzw. weis nicht was diese bedeuten. Kannst du mir dabei helfen?

Dec 1 16:20:35 pve systemd[1]: Started User Manager for UID 0. Dec 1 16:20:35 pve systemd[1]: Started Session 648567 of user root. Dec 1 16:20:35 pve systemd[1]: session-648567.scope: Succeeded. Dec 1 16:20:46 pve systemd[1]: Stopping User Manager for UID 0... Dec 1 16:20:46 pve systemd[5008]: Stopped target Default. Dec 1 16:20:46 pve systemd[5008]: Stopped target Basic System. Dec 1 16:20:46 pve systemd[5008]: Stopped target Sockets. Dec 1 16:20:46 pve systemd[5008]: gpg-agent-browser.socket: Succeeded. Dec 1 16:20:46 pve systemd[5008]: Closed GnuPG cryptographic agent and passphrase cache (access for web browsers). Dec 1 16:20:46 pve systemd[5008]: gpg-agent-extra.socket: Succeeded. Dec 1 16:20:46 pve systemd[5008]: Closed GnuPG cryptographic agent and passphrase cache (restricted). Dec 1 16:20:46 pve systemd[5008]: gpg-agent-ssh.socket: Succeeded. Dec 1 16:20:46 pve systemd[5008]: Closed GnuPG cryptographic agent (ssh-agent emulation). Dec 1 16:20:46 pve systemd[5008]: gpg-agent.socket: Succeeded. Dec 1 16:20:46 pve systemd[5008]: Closed GnuPG cryptographic agent and passphrase cache. Dec 1 16:20:46 pve systemd[5008]: Stopped target Paths. Dec 1 16:20:46 pve systemd[5008]: dirmngr.socket: Succeeded. Dec 1 16:20:46 pve systemd[5008]: Closed GnuPG network certificate management daemon. Dec 1 16:20:46 pve systemd[5008]: Reached target Shutdown. Dec 1 16:20:46 pve systemd[5008]: systemd-exit.service: Succeeded. Dec 1 16:20:46 pve systemd[5008]: Started Exit the Session. Dec 1 16:20:46 pve systemd[5008]: Reached target Exit the Session. Dec 1 16:20:46 pve systemd[5008]: Stopped target Timers. Dec 1 16:20:46 pve systemd[1]: user@0.service: Succeeded. Dec 1 16:20:46 pve systemd[1]: Stopped User Manager for UID 0. Dec 1 16:20:46 pve systemd[1]: Stopping User Runtime Directory /run/user/0... Dec 1 16:20:46 pve systemd[1]: run-user-0.mount: Succeeded. Dec 1 16:20:46 pve systemd[1]: user-runtime-dir@0.service: Succeeded. Dec 1 16:20:46 pve systemd[1]: Stopped User Runtime Directory /run/user/0. Dec 1 16:20:46 pve systemd[1]: Removed slice User Slice of UID 0. Dec 1 16:20:46 pve kernel: [15727012.768691] e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: Dec 1 16:20:46 pve kernel: [15727012.768691] TDH <f7> Dec 1 16:20:46 pve kernel: [15727012.768691] TDT <36> Dec 1 16:20:46 pve kernel: [15727012.768691] next_to_use <36> Dec 1 16:20:46 pve kernel: [15727012.768691] next_to_clean <f6> Dec 1 16:20:46 pve kernel: [15727012.768691] buffer_info[next_to_clean]: Dec 1 16:20:46 pve kernel: [15727012.768691] time_stamp <1ea5956cb> Dec 1 16:20:46 pve kernel: [15727012.768691] next_to_watch <f7> Dec 1 16:20:46 pve kernel: [15727012.768691] jiffies <1ea5958b1> Dec 1 16:20:46 pve kernel: [15727012.768691] next_to_watch.status <0> Dec 1 16:20:46 pve kernel: [15727012.768691] MAC Status <40080083> Dec 1 16:20:46 pve kernel: [15727012.768691] PHY Status <796d> Dec 1 16:20:46 pve kernel: [15727012.768691] PHY 1000BASE-T Status <3800> Dec 1 16:20:46 pve kernel: [15727012.768691] PHY Extended Status <3000> Dec 1 16:20:46 pve kernel: [15727012.768691] PCI Status <10> Dec 1 16:20:48 pve kernel: [15727014.784669] e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: Dec 1 16:20:48 pve kernel: [15727014.784669] TDH <f7> Dec 1 16:20:48 pve kernel: [15727014.784669] TDT <36> Dec 1 16:20:48 pve kernel: [15727014.784669] next_to_use <36> Dec 1 16:20:48 pve kernel: [15727014.784669] next_to_clean <f6> Dec 1 16:20:48 pve kernel: [15727014.784669] buffer_info[next_to_clean]: Dec 1 16:20:48 pve kernel: [15727014.784669] time_stamp <1ea5956cb> Dec 1 16:20:48 pve kernel: [15727014.784669] next_to_watch <f7> Dec 1 16:20:48 pve kernel: [15727014.784669] jiffies <1ea595aa9> Dec 1 16:20:48 pve kernel: [15727014.784669] next_to_watch.status <0> Dec 1 16:20:48 pve kernel: [15727014.784669] MAC Status <40080083> Dec 1 16:20:48 pve kernel: [15727014.784669] PHY Status <796d> Dec 1 16:20:48 pve kernel: [15727014.784669] PHY 1000BASE-T Status <3800> Dec 1 16:20:48 pve kernel: [15727014.784669] PHY Extended Status <3000> Dec 1 16:20:48 pve kernel: [15727014.784669] PCI Status <10> Dec 1 16:20:50 pve kernel: [15727016.768716] e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: Dec 1 16:20:50 pve kernel: [15727016.768716] TDH <f7> Dec 1 16:20:50 pve kernel: [15727016.768716] TDT <36> Dec 1 16:20:50 pve kernel: [15727016.768716] next_to_use <36> Dec 1 16:20:50 pve kernel: [15727016.768716] next_to_clean <f6> Dec 1 16:20:50 pve kernel: [15727016.768716] buffer_info[next_to_clean]: Dec 1 16:20:50 pve kernel: [15727016.768716] time_stamp <1ea5956cb> Dec 1 16:20:50 pve kernel: [15727016.768716] next_to_watch <f7> Dec 1 16:20:50 pve kernel: [15727016.768716] jiffies <1ea595c99> Dec 1 16:20:50 pve kernel: [15727016.768716] next_to_watch.status <0> Dec 1 16:20:50 pve kernel: [15727016.768716] MAC Status <40080083> Dec 1 16:20:50 pve kernel: [15727016.768716] PHY Status <796d> Dec 1 16:20:50 pve kernel: [15727016.768716] PHY 1000BASE-T Status <3800> Dec 1 16:20:50 pve kernel: [15727016.768716] PHY Extended Status <3000> Dec 1 16:20:50 pve kernel: [15727016.768716] PCI Status <10> Dec 1 16:20:52 pve kernel: [15727018.780704] e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: Dec 1 16:20:52 pve kernel: [15727018.780704] TDH <f7> Dec 1 16:20:52 pve kernel: [15727018.780704] TDT <36> Dec 1 16:20:52 pve kernel: [15727018.780704] next_to_use <36> Dec 1 16:20:52 pve kernel: [15727018.780704] next_to_clean <f6> Dec 1 16:20:52 pve kernel: [15727018.780704] buffer_info[next_to_clean]: Dec 1 16:20:52 pve kernel: [15727018.780704] time_stamp <1ea5956cb> Dec 1 16:20:52 pve kernel: [15727018.780704] next_to_watch <f7> Dec 1 16:20:52 pve kernel: [15727018.780704] jiffies <1ea595e90> Dec 1 16:20:52 pve kernel: [15727018.780704] next_to_watch.status <0> Dec 1 16:20:52 pve kernel: [15727018.780704] MAC Status <40080083> Dec 1 16:20:52 pve kernel: [15727018.780704] PHY Status <796d> Dec 1 16:20:52 pve kernel: [15727018.780704] PHY 1000BASE-T Status <3800> Dec 1 16:20:52 pve kernel: [15727018.780704] PHY Extended Status <3000> Dec 1 16:20:52 pve kernel: [15727018.780704] PCI Status <10> Dec 1 16:20:53 pve kernel: [15727019.996459] e1000e 0000:00:1f.6 eno1: Reset adapter unexpectedly Dec 1 16:20:54 pve kernel: [15727020.086074] vmbr0: port 1(eno1) entered disabled state Dec 1 16:20:59 pve kernel: [15727025.704797] e1000e: eno1 NIC Link is Up 1000 Mbps Full Duplex, Flow Control: None Dec 1 16:20:59 pve kernel: [15727025.704874] vmbr0: port 1(eno1) entered blocking state Dec 1 16:20:59 pve kernel: [15727025.704879] vmbr0: port 1(eno1) entered forwarding state Dec 1 16:21:00 pve systemd[1]: Starting Proxmox VE replication runner... Dec 1 16:21:01 pve systemd[1]: pvesr.service: Succeeded. Dec 1 16:21:01 pve systemd[1]: Started Proxmox VE replication runner. Dec 1 16:21:03 pve pvestatd[972]: storage 'Diskstation' is not online Dec 1 16:21:03 pve pvestatd[972]: status update time (10.198 seconds) Dec 1 16:21:36 pve systemd[1]: Starting Cleanup of Temporary Directories... Dec 1 16:21:36 pve systemd[1]: Created slice User Slice of UID 0. Dec 1 16:21:36 pve systemd[1]: Starting User Runtime Directory /run/user/0... Dec 1 16:21:36 pve systemd[1]: Started User Runtime Directory /run/user/0. Dec 1 16:21:36 pve systemd[1]: Starting User Manager for UID 0... Dec 1 16:21:36 pve systemd[1]: systemd-tmpfiles-clean.service: Succeeded. Dec 1 16:21:36 pve systemd[1]: Started Cleanup of Temporary Directories. Dec 1 16:21:36 pve systemd[5262]: Reached target Paths. Dec 1 16:21:36 pve systemd[5262]: Listening on GnuPG cryptographic agent and passphrase cache. Dec 1 16:21:36 pve systemd[5262]: Listening on GnuPG network certificate management daemon. Dec 1 16:21:36 pve systemd[5262]: Listening on GnuPG cryptographic agent (ssh-agent emulation). Dec 1 16:21:36 pve systemd[5262]: Reached target Timers. Dec 1 16:21:36 pve systemd[5262]: Listening on GnuPG cryptographic agent and passphrase cache (access for web browsers). Dec 1 16:21:36 pve systemd[5262]: Listening on GnuPG cryptographic agent and passphrase cache (restricted). Dec 1 16:21:36 pve systemd[5262]: Reached target Sockets. Dec 1 16:21:36 pve systemd[5262]: Reached target Basic System. Dec 1 16:21:36 pve systemd[5262]: Reached target Default.Dec 3 18:05:59 pve systemd[1]: user@0.service: Succeeded. Dec 3 18:05:59 pve systemd[1]: Stopped User Manager for UID 0. Dec 3 18:05:59 pve systemd[1]: Stopping User Runtime Directory /run/user/0... Dec 3 18:05:59 pve systemd[1]: run-user-0.mount: Succeeded. Dec 3 18:05:59 pve systemd[1]: user-runtime-dir@0.service: Succeeded. Dec 3 18:05:59 pve systemd[1]: Stopped User Runtime Directory /run/user/0. Dec 3 18:05:59 pve systemd[1]: Removed slice User Slice of UID 0. Dec 3 18:06:00 pve systemd[1]: Starting Proxmox VE replication runner... Dec 3 18:06:01 pve systemd[1]: pvesr.service: Succeeded. Dec 3 18:06:01 pve systemd[1]: Started Proxmox VE replication runner. Dec 3 18:06:04 pve kernel: [73500.804549] e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: Dec 3 18:06:04 pve kernel: [73500.804549] TDH <70> Dec 3 18:06:04 pve kernel: [73500.804549] TDT <d2> Dec 3 18:06:04 pve kernel: [73500.804549] next_to_use <d2> Dec 3 18:06:04 pve kernel: [73500.804549] next_to_clean <6f> Dec 3 18:06:04 pve kernel: [73500.804549] buffer_info[next_to_clean]: Dec 3 18:06:04 pve kernel: [73500.804549] time_stamp <101173be6> Dec 3 18:06:04 pve kernel: [73500.804549] next_to_watch <70> Dec 3 18:06:04 pve kernel: [73500.804549] jiffies <101173e28> Dec 3 18:06:04 pve kernel: [73500.804549] next_to_watch.status <0> Dec 3 18:06:04 pve kernel: [73500.804549] MAC Status <40080083> Dec 3 18:06:04 pve kernel: [73500.804549] PHY Status <796d> Dec 3 18:06:04 pve kernel: [73500.804549] PHY 1000BASE-T Status <3800> Dec 3 18:06:04 pve kernel: [73500.804549] PHY Extended Status <3000> Dec 3 18:06:04 pve kernel: [73500.804549] PCI Status <10> Dec 3 18:06:06 pve kernel: [73502.788467] e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: Dec 3 18:06:06 pve kernel: [73502.788467] TDH <70> Dec 3 18:06:06 pve kernel: [73502.788467] TDT <d2> Dec 3 18:06:06 pve kernel: [73502.788467] next_to_use <d2> Dec 3 18:06:06 pve kernel: [73502.788467] next_to_clean <6f> Dec 3 18:06:06 pve kernel: [73502.788467] buffer_info[next_to_clean]: Dec 3 18:06:06 pve kernel: [73502.788467] time_stamp <101173be6> Dec 3 18:06:06 pve kernel: [73502.788467] next_to_watch <70> Dec 3 18:06:06 pve kernel: [73502.788467] jiffies <101174018> Dec 3 18:06:06 pve kernel: [73502.788467] next_to_watch.status <0> Dec 3 18:06:06 pve kernel: [73502.788467] MAC Status <40080083> Dec 3 18:06:06 pve kernel: [73502.788467] PHY Status <796d> Dec 3 18:06:06 pve kernel: [73502.788467] PHY 1000BASE-T Status <3800> Dec 3 18:06:06 pve kernel: [73502.788467] PHY Extended Status <3000> Dec 3 18:06:06 pve kernel: [73502.788467] PCI Status <10> Dec 3 18:06:08 pve kernel: [73504.804456] e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: Dec 3 18:06:08 pve kernel: [73504.804456] TDH <70> Dec 3 18:06:08 pve kernel: [73504.804456] TDT <d2> Dec 3 18:06:08 pve kernel: [73504.804456] next_to_use <d2> Dec 3 18:06:08 pve kernel: [73504.804456] next_to_clean <6f> Dec 3 18:06:08 pve kernel: [73504.804456] buffer_info[next_to_clean]: Dec 3 18:06:08 pve kernel: [73504.804456] time_stamp <101173be6> Dec 3 18:06:08 pve kernel: [73504.804456] next_to_watch <70> Dec 3 18:06:08 pve kernel: [73504.804456] jiffies <101174210> Dec 3 18:06:08 pve kernel: [73504.804456] next_to_watch.status <0> Dec 3 18:06:08 pve kernel: [73504.804456] MAC Status <40080083> Dec 3 18:06:08 pve kernel: [73504.804456] PHY Status <796d> Dec 3 18:06:08 pve kernel: [73504.804456] PHY 1000BASE-T Status <3800> Dec 3 18:06:08 pve kernel: [73504.804456] PHY Extended Status <3000> Dec 3 18:06:08 pve kernel: [73504.804456] PCI Status <10> Dec 3 18:06:09 pve kernel: [73506.020237] e1000e 0000:00:1f.6 eno1: Reset adapter unexpectedly Dec 3 18:06:10 pve kernel: [73506.109993] vmbr0: port 1(eno1) entered disabled state Dec 3 18:06:13 pve kernel: [73509.774753] e1000e: eno1 NIC Link is Up 1000 Mbps Full Duplex, Flow Control: None Dec 3 18:06:13 pve kernel: [73509.774832] vmbr0: port 1(eno1) entered blocking state Dec 3 18:06:13 pve kernel: [73509.774835] vmbr0: port 1(eno1) entered forwarding state Dec 3 18:06:19 pve pvestatd[1010]: status update time (7.290 seconds) Dec 3 18:06:49 pve systemd[1]: Created slice User Slice of UID 0. Dec 3 18:06:49 pve systemd[1]: Starting User Runtime Directory /run/user/0... Dec 3 18:06:49 pve systemd[1]: Started User Runtime Directory /run/user/0. Dec 3 18:06:49 pve systemd[1]: Starting User Manager for UID 0... Dec 3 18:06:49 pve systemd[16815]: Listening on GnuPG cryptographic agent and passphrase cache (access for web browsers). Dec 3 18:06:49 pve systemd[16815]: Listening on GnuPG network certificate management daemon. Dec 3 18:06:49 pve systemd[16815]: Listening on GnuPG cryptographic agent (ssh-agent emulation). Dec 3 18:06:49 pve systemd[16815]: Listening on GnuPG cryptographic agent and passphrase cache (restricted). Dec 3 18:06:49 pve systemd[16815]: Listening on GnuPG cryptographic agent and passphrase cache. Dec 3 18:06:49 pve systemd[16815]: Reached target Sockets. Dec 3 18:06:49 pve systemd[16815]: Reached target Paths. Dec 3 18:06:49 pve systemd[16815]: Reached target Timers. Dec 3 18:06:49 pve systemd[16815]: Reached target Basic System. Dec 3 18:06:49 pve systemd[16815]: Reached target Default. Dec 3 18:06:49 pve systemd[16815]: Startup finished in 30ms. Dec 3 18:06:49 pve systemd[1]: Started User Manager for UID 0.Dec 3 16:31:45 pve systemd[1]: user@0.service: Succeeded. Dec 3 16:31:45 pve systemd[1]: Stopped User Manager for UID 0. Dec 3 16:31:45 pve systemd[1]: Stopping User Runtime Directory /run/user/0... Dec 3 16:31:45 pve systemd[1]: run-user-0.mount: Succeeded. Dec 3 16:31:45 pve systemd[1]: user-runtime-dir@0.service: Succeeded. Dec 3 16:31:45 pve systemd[1]: Stopped User Runtime Directory /run/user/0. Dec 3 16:31:45 pve systemd[1]: Removed slice User Slice of UID 0. Dec 3 16:32:00 pve systemd[1]: Starting Proxmox VE replication runner... Dec 3 16:32:01 pve systemd[1]: pvesr.service: Succeeded. Dec 3 16:32:01 pve systemd[1]: Started Proxmox VE replication runner. Dec 3 16:32:04 pve kernel: [67860.869955] e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: Dec 3 16:32:04 pve kernel: [67860.869955] TDH <3> Dec 3 16:32:04 pve kernel: [67860.869955] TDT <16> Dec 3 16:32:04 pve kernel: [67860.869955] next_to_use <16> Dec 3 16:32:04 pve kernel: [67860.869955] next_to_clean <2> Dec 3 16:32:04 pve kernel: [67860.869955] buffer_info[next_to_clean]: Dec 3 16:32:04 pve kernel: [67860.869955] time_stamp <10101b77d> Dec 3 16:32:04 pve kernel: [67860.869955] next_to_watch <3> Dec 3 16:32:04 pve kernel: [67860.869955] jiffies <10101ba58> Dec 3 16:32:04 pve kernel: [67860.869955] next_to_watch.status <0> Dec 3 16:32:04 pve kernel: [67860.869955] MAC Status <40080083> Dec 3 16:32:04 pve kernel: [67860.869955] PHY Status <796d> Dec 3 16:32:04 pve kernel: [67860.869955] PHY 1000BASE-T Status <3800> Dec 3 16:32:04 pve kernel: [67860.869955] PHY Extended Status <3000> Dec 3 16:32:04 pve kernel: [67860.869955] PCI Status <10> Dec 3 16:32:06 pve kernel: [67862.885867] e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: Dec 3 16:32:06 pve kernel: [67862.885867] TDH <3> Dec 3 16:32:06 pve kernel: [67862.885867] TDT <16> Dec 3 16:32:06 pve kernel: [67862.885867] next_to_use <16> Dec 3 16:32:06 pve kernel: [67862.885867] next_to_clean <2> Dec 3 16:32:06 pve kernel: [67862.885867] buffer_info[next_to_clean]: Dec 3 16:32:06 pve kernel: [67862.885867] time_stamp <10101b77d> Dec 3 16:32:06 pve kernel: [67862.885867] next_to_watch <3> Dec 3 16:32:06 pve kernel: [67862.885867] jiffies <10101bc50> Dec 3 16:32:06 pve kernel: [67862.885867] next_to_watch.status <0> Dec 3 16:32:06 pve kernel: [67862.885867] MAC Status <40080083> Dec 3 16:32:06 pve kernel: [67862.885867] PHY Status <796d> Dec 3 16:32:06 pve kernel: [67862.885867] PHY 1000BASE-T Status <3800> Dec 3 16:32:06 pve kernel: [67862.885867] PHY Extended Status <3000> Dec 3 16:32:06 pve kernel: [67862.885867] PCI Status <10> Dec 3 16:32:08 pve kernel: [67864.873662] ------------[ cut here ]------------ Dec 3 16:32:08 pve kernel: [67864.873665] NETDEV WATCHDOG: eno1 (e1000e): transmit queue 0 timed out Dec 3 16:32:08 pve kernel: [67864.873679] WARNING: CPU: 0 PID: 0 at net/sched/sch_generic.c:473 dev_watchdog+0x264/0x270 Dec 3 16:32:08 pve kernel: [67864.873680] Modules linked in: dm_snapshot veth rpcsec_gss_krb5 auth_rpcgss nfsv4 nfs lockd grace fscache ebtable_filter ebtables ip_set ip6table_raw iptable_raw ip6table_filter ip6_tables iptable_filter bpfilter softdog nfnetlink_log nfnetlink snd_hda_codec_hdmi snd_hda_codec_realtek snd_hda_codec_generic snd_sof_pci snd_sof_intel_hda_common snd_soc_hdac_hda snd_sof_intel_hda snd_sof_intel_byt snd_sof_intel_ipc intel_rapl_msr snd_sof snd_sof_xtensa_dsp intel_rapl_common x86_pkg_temp_thermal intel_powerclamp snd_hda_ext_core snd_soc_acpi_intel_match snd_soc_acpi iwlmvm mei_hdcp ledtrig_audio coretemp btusb kvm_intel kvm irqbypass i915 mac80211 snd_soc_core btrtl crct10dif_pclmul libarc4 snd_compress btbcm btintel drm_kms_helper crc32_pclmul ac97_bus drm bluetooth i2c_algo_bit iwlwifi cp210x snd_pcm_dmaengine fb_sys_fops syscopyarea ghash_clmulni_intel ecdh_generic aesni_intel snd_hda_intel crypto_simd snd_intel_dspcfg snd_hda_codec snd_hda_core snd_hwdep cryptd snd_pcm glue_helper Dec 3 16:32:08 pve kernel: [67864.873714] snd_timer rapl snd mei_me intel_cstate pcspkr wmi_bmof intel_wmi_thunderbolt soundcore mei cdc_acm usbserial ecc cfg80211 sysfillrect sysimgblt mac_hid acpi_tad acpi_pad zfs(PO) zunicode(PO) zzstd(O) zlua(O) zavl(PO) icp(PO) zcommon(PO) znvpair(PO) spl(O) vhost_net vhost tap ib_iser rdma_cm iw_cm ib_cm ib_core iscsi_tcp libiscsi_tcp libiscsi scsi_transport_iscsi sunrpc ip_tables x_tables autofs4 btrfs xor zstd_compress raid6_pq dm_thin_pool dm_persistent_data dm_bio_prison dm_bufio libcrc32c hid_generic usbhid hid sdhci_pci cqhci sdhci e1000e i2c_i801 xhci_pci ahci thunderbolt intel_lpss_pci libahci intel_lpss idma64 xhci_hcd virt_dma wmi video pinctrl_cannonlake pinctrl_intel Dec 3 16:32:08 pve kernel: [67864.873733] CPU: 0 PID: 0 Comm: swapper/0 Tainted: P O 5.4.151-1-pve #1 Dec 3 16:32:08 pve kernel: [67864.873734] Hardware name: Intel(R) Client Systems NUC10i3FNH/NUC10i3FNB, BIOS FNCML357.0047.2020.1118.1629 11/18/2020 Dec 3 16:32:08 pve kernel: [67864.873735] RIP: 0010:dev_watchdog+0x264/0x270 Dec 3 16:32:08 pve kernel: [67864.873737] Code: 48 85 c0 75 e6 eb a0 4c 89 ef c6 05 22 86 ef 00 01 e8 60 b7 fa ff 89 d9 4c 89 ee 48 c7 c7 40 72 23 98 48 89 c2 e8 70 65 15 00 <0f> 0b eb 82 0f 1f 84 00 00 00 00 00 0f 1f 44 00 00 55 48 89 e5 41 Dec 3 16:32:08 pve kernel: [67864.873737] RSP: 0018:ffffa13580003e58 EFLAGS: 00010282 Dec 3 16:32:08 pve kernel: [67864.873738] RAX: 0000000000000000 RBX: 0000000000000000 RCX: 0000000000000006 Dec 3 16:32:08 pve kernel: [67864.873738] RDX: 0000000000000007 RSI: 0000000000000082 RDI: ffff91abf0c178c0 Dec 3 16:32:08 pve kernel: [67864.873739] RBP: ffffa13580003e88 R08: 000000000000047b R09: 0000000000000004 Dec 3 16:32:08 pve kernel: [67864.873739] R10: 0000000000000000 R11: 0000000000000001 R12: 0000000000000001 Dec 3 16:32:08 pve kernel: [67864.873739] R13: ffff91abe17d4000 R14: ffff91abe17d4480 R15: ffff91abe1787c80 Dec 3 16:32:08 pve kernel: [67864.873740] FS: 0000000000000000(0000) GS:ffff91abf0c00000(0000) knlGS:0000000000000000 Dec 3 16:32:08 pve kernel: [67864.873740] CS: 0010 DS: 0000 ES: 0000 CR0: 0000000080050033 Dec 3 16:32:08 pve kernel: [67864.873741] CR2: 00007ffccc3fdb88 CR3: 000000002160a006 CR4: 00000000003626f0 Dec 3 16:32:08 pve kernel: [67864.873741] Call Trace: Dec 3 16:32:08 pve kernel: [67864.873742] <IRQ> Dec 3 16:32:08 pve kernel: [67864.873745] ? pfifo_fast_enqueue+0x160/0x160 Dec 3 16:32:08 pve kernel: [67864.873747] call_timer_fn+0x32/0x130 Dec 3 16:32:08 pve kernel: [67864.873748] run_timer_softirq+0x1a5/0x430 Dec 3 16:32:08 pve kernel: [67864.873749] ? enqueue_hrtimer+0x3c/0x90 Dec 3 16:32:08 pve kernel: [67864.873750] ? ktime_get+0x3c/0xa0 Dec 3 16:32:08 pve kernel: [67864.873751] ? lapic_next_deadline+0x2c/0x40 Dec 3 16:32:08 pve kernel: [67864.873753] ? clockevents_program_event+0x93/0xf0 Dec 3 16:32:08 pve kernel: [67864.873755] __do_softirq+0xdc/0x2d4 Dec 3 16:32:08 pve kernel: [67864.873756] irq_exit+0xa9/0xb0 Dec 3 16:32:08 pve kernel: [67864.873757] smp_apic_timer_interrupt+0x79/0x130 Dec 3 16:32:08 pve kernel: [67864.873758] apic_timer_interrupt+0xf/0x20 Dec 3 16:32:08 pve kernel: [67864.873759] </IRQ> Dec 3 16:32:08 pve kernel: [67864.873761] RIP: 0010:cpuidle_enter_state+0xbd/0x450 Dec 3 16:32:08 pve kernel: [67864.873761] Code: ff e8 f7 41 88 ff 80 7d c7 00 74 17 9c 58 0f 1f 44 00 00 f6 c4 02 0f 85 63 03 00 00 31 ff e8 da 50 8e ff fb 66 0f 1f 44 00 00 <45> 85 ed 0f 88 8d 02 00 00 49 63 cd 48 8b 75 d0 48 2b 75 c8 48 8d Dec 3 16:32:08 pve kernel: [67864.873762] RSP: 0018:ffffffff98403de8 EFLAGS: 00000246 ORIG_RAX: ffffffffffffff13 Dec 3 16:32:08 pve kernel: [67864.873762] RAX: ffff91abf0c2ae40 RBX: ffffffff98557da0 RCX: 000000000000001f Dec 3 16:32:08 pve kernel: [67864.873763] RDX: 00003db905afd05c RSI: 000000003161faed RDI: 0000000000000000 Dec 3 16:32:08 pve kernel: [67864.873763] RBP: ffffffff98403e28 R08: 0000000000000002 R09: 000000000002a6c0 Dec 3 16:32:08 pve kernel: [67864.873764] R10: 0000a004ca71c794 R11: ffff91abf0c29ae0 R12: ffff91abf0c36c00 Dec 3 16:32:08 pve kernel: [67864.873764] R13: 0000000000000004 R14: ffffffff98557f38 R15: ffffffff98557f20 Dec 3 16:32:08 pve kernel: [67864.873766] ? cpuidle_enter_state+0x99/0x450 Dec 3 16:32:08 pve kernel: [67864.873767] cpuidle_enter+0x2e/0x40 Dec 3 16:32:08 pve kernel: [67864.873768] call_cpuidle+0x23/0x40 Dec 3 16:32:08 pve kernel: [67864.873769] do_idle+0x22c/0x270 Dec 3 16:32:08 pve kernel: [67864.873770] cpu_startup_entry+0x1d/0x20 Dec 3 16:32:08 pve kernel: [67864.873772] rest_init+0xae/0xb0 Dec 3 16:32:08 pve kernel: [67864.873773] arch_call_rest_init+0xe/0x1b Dec 3 16:32:08 pve kernel: [67864.873774] start_kernel+0x54c/0x56e Dec 3 16:32:08 pve kernel: [67864.873775] x86_64_start_reservations+0x24/0x26 Dec 3 16:32:08 pve kernel: [67864.873776] x86_64_start_kernel+0x74/0x77 Dec 3 16:32:08 pve kernel: [67864.873777] secondary_startup_64+0xa4/0xb0 Dec 3 16:32:08 pve kernel: [67864.873778] ---[ end trace 32f771dd5fd2b1f8 ]--- Dec 3 16:32:08 pve kernel: [67864.873793] e1000e 0000:00:1f.6 eno1: Reset adapter unexpectedly Dec 3 16:32:08 pve kernel: [67864.963212] vmbr0: port 1(eno1) entered disabled state Dec 3 16:32:12 pve kernel: [67868.620238] e1000e: eno1 NIC Link is Up 1000 Mbps Full Duplex, Flow Control: None Dec 3 16:32:12 pve kernel: [67868.620335] vmbr0: port 1(eno1) entered blocking state Dec 3 16:32:12 pve kernel: [67868.620338] vmbr0: port 1(eno1) entered forwarding state Dec 3 16:32:19 pve pvestatd[1010]: status update time (7.459 seconds) Dec 3 16:32:35 pve systemd[1]: Created slice User Slice of UID 0. Dec 3 16:32:35 pve systemd[1]: Starting User Runtime Directory /run/user/0... Dec 3 16:32:35 pve systemd[1]: Started User Runtime Directory /run/user/0. Dec 3 16:32:35 pve systemd[1]: Starting User Manager for UID 0... Dec 3 16:32:35 pve systemd[25320]: Listening on GnuPG cryptographic agent and passphrase cache. Dec 3 16:32:35 pve systemd[25320]: Listening on GnuPG cryptographic agent and passphrase cache (access for web browsers). Dec 3 16:32:35 pve systemd[25320]: Listening on GnuPG network certificate management daemon. Dec 3 16:32:35 pve systemd[25320]: Listening on GnuPG cryptographic agent (ssh-agent emulation). Dec 3 16:32:35 pve systemd[25320]: Listening on GnuPG cryptographic agent and passphrase cache (restricted). Dec 3 16:32:35 pve systemd[25320]: Reached target Sockets. Dec 3 16:32:35 pve systemd[25320]: Reached target Paths. Dec 3 16:32:35 pve systemd[25320]: Reached target Timers. Dec 3 16:32:35 pve systemd[25320]: Reached target Basic System. Dec 3 16:32:35 pve systemd[25320]: Reached target Default. Dec 3 16:32:35 pve systemd[25320]: Startup finished in 31ms. Dec 3 16:32:35 pve systemd[1]: Started User Manager for UID 0.Sind die Einstellungen richtig?

@saeft_2003 sagte in Gelegentliche Verbindungsabbrüche (zigbee, telegram, wled):

Sind die Einstellungen richtig?

ja, ist ne standard Einstellung

@saeft_2003 sagte in Gelegentliche Verbindungsabbrüche (zigbee, telegram, wled):

weis nicht was diese bedeuten. Kannst du mir dabei helfen

da bin ich der falsche Ansprechpartner, bin da nicht so bewandert.

zue1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang:hab ich das gefunden

https://www.taste-of-it.de/proxmox-ve-detected-hardware-unit-hang/

bzw

https://forum.proxmox.com/threads/e1000e-eno1-detected-hardware-unit-hang.59928/

in beiden Post wird darauf hingewiesen, das zu ändernethtool -K eth0 tx off rx off -

@saeft_2003 sagte in Gelegentliche Verbindungsabbrüche (zigbee, telegram, wled):

Sind die Einstellungen richtig?

ja, ist ne standard Einstellung

@saeft_2003 sagte in Gelegentliche Verbindungsabbrüche (zigbee, telegram, wled):

weis nicht was diese bedeuten. Kannst du mir dabei helfen

da bin ich der falsche Ansprechpartner, bin da nicht so bewandert.

zue1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang:hab ich das gefunden

https://www.taste-of-it.de/proxmox-ve-detected-hardware-unit-hang/

bzw

https://forum.proxmox.com/threads/e1000e-eno1-detected-hardware-unit-hang.59928/

in beiden Post wird darauf hingewiesen, das zu ändernethtool -K eth0 tx off rx offDanke für deine Mühe ich hatte jetzt auch schon ein wenig rumgegoogelt und schnell gemerkt das ich nicht der einzige bin mit dem Problem. Ich bin sehr gespannt ob die angegebene Lösung funktioniert....

-

Ich habe das gleiche Problem bei mir kommt auch diese Fehlermeldung was hast du nun gemacht das der Fehler aufhört?

Dec 05 14:16:25 pve kernel: e1000e 0000:00:1f.6 eno1: NIC Link is Down Dec 05 14:16:25 pve kernel: vmbr0: port 1(eno1) entered disabled state Dec 05 14:16:28 pve kernel: e1000e 0000:00:1f.6 eno1: NIC Link is Up 100 Mbps Full Duplex, Flow Control: Rx/Tx Dec 05 14:16:28 pve kernel: e1000e 0000:00:1f.6 eno1: 10/100 speed: disabling TSO Dec 05 14:16:28 pve kernel: vmbr0: port 1(eno1) entered blocking state Dec 05 14:16:28 pve kernel: vmbr0: port 1(eno1) entered forwarding state -

Ich habe das gleiche Problem bei mir kommt auch diese Fehlermeldung was hast du nun gemacht das der Fehler aufhört?

Dec 05 14:16:25 pve kernel: e1000e 0000:00:1f.6 eno1: NIC Link is Down Dec 05 14:16:25 pve kernel: vmbr0: port 1(eno1) entered disabled state Dec 05 14:16:28 pve kernel: e1000e 0000:00:1f.6 eno1: NIC Link is Up 100 Mbps Full Duplex, Flow Control: Rx/Tx Dec 05 14:16:28 pve kernel: e1000e 0000:00:1f.6 eno1: 10/100 speed: disabling TSO Dec 05 14:16:28 pve kernel: vmbr0: port 1(eno1) entered blocking state Dec 05 14:16:28 pve kernel: vmbr0: port 1(eno1) entered forwarding stateich will mich nicht zu früh freun, aber es sieht aus als wäre es weg.

https://forum.proxmox.com/threads/e1000-driver-hang.58284/page-8

apt install -y ethtool ethtool -K eth0 gso off gro off tso off tx off rx off rxvlan off txvlan off sg offdas ist aber nach einem reboot wieder weg deswegen muss man es fest in die network interfaces eintragen.

-

ich will mich nicht zu früh freun, aber es sieht aus als wäre es weg.

https://forum.proxmox.com/threads/e1000-driver-hang.58284/page-8

apt install -y ethtool ethtool -K eth0 gso off gro off tso off tx off rx off rxvlan off txvlan off sg offdas ist aber nach einem reboot wieder weg deswegen muss man es fest in die network interfaces eintragen.

@saeft_2003 Und was ist das genau für ein Fehler. Das ich das auch verstehe. :)

-

@saeft_2003 Und was ist das genau für ein Fehler. Das ich das auch verstehe. :)

Wohl irgendwie ein Treiberfehler im Kernel. Aber wirklich Ahnung hab ich davon nicht Hauptsache es geht…

-

Wohl irgendwie ein Treiberfehler im Kernel. Aber wirklich Ahnung hab ich davon nicht Hauptsache es geht…

@saeft_2003 Ok :)

-

@saeft_2003 Ok :)

Da es den Fehler schon sehr lange gibt verstehe ich bloß nicht warum der nicht mit einem Update behoben wird?!

Bei mir läuft es jetzt schon 2 Tage fehlerfrei, sonst kam es am Tag manchmal sogar mehrfach. Sollte bei mir also behoben sein…

-

@saeft_2003 Bei mir war es mehrmals am Tag gekommen. Und das ganze erst früh 10:45 was irgendwie komisch ist. Ich habe jetzt mal das ganze direkt in meinen Router gesteckt und über 1gb Verbindung verbunden. Anstatt 100mbits vielleicht war das schon das Problem.

Das ganze läuft jetzt 20h ohne Abbrüche aber ich möchte es nicht so laut sagen :) -

@saeft_2003 Bei mir war es mehrmals am Tag gekommen. Und das ganze erst früh 10:45 was irgendwie komisch ist. Ich habe jetzt mal das ganze direkt in meinen Router gesteckt und über 1gb Verbindung verbunden. Anstatt 100mbits vielleicht war das schon das Problem.

Das ganze läuft jetzt 20h ohne Abbrüche aber ich möchte es nicht so laut sagen :) -

Ich habe noch einmal Fragen zu diesen Thema seit paar Tagen kommt bei mir folgende Fehler. Hat das mit der Konfiguration des Netzwerk Adapter zutun in Proxmox?

an 21 19:17:59 pve pvestatd[1028]: auth key pair too old, rotating.. Jan 21 19:59:51 pve kernel: e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: TDH <a> TDT <90> next_to_use <90> next_to_clean <9> buffer_info[next_to_clean]: time_stamp <10fac799d> next_to_watch <a> jiffies <10fac7b18> next_to_watch.status <0> MAC Status <40080083> PHY Status <796d> PHY 1000BASE-T Status <7800> PHY Extended Status <3000> PCI Status <10> Jan 21 19:59:53 pve kernel: e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: TDH <a> TDT <90> next_to_use <90> next_to_clean <9> buffer_info[next_to_clean]: time_stamp <10fac799d> next_to_watch <a> jiffies <10fac7d08> next_to_watch.status <0> MAC Status <40080083> PHY Status <796d> PHY 1000BASE-T Status <7800> PHY Extended Status <3000> PCI Status <10> Jan 21 19:59:55 pve kernel: e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: TDH <a> TDT <90> next_to_use <90> next_to_clean <9> buffer_info[next_to_clean]: time_stamp <10fac799d> next_to_watch <a> jiffies <10fac7f00> next_to_watch.status <0> MAC Status <40080083> PHY Status <796d> PHY 1000BASE-T Status <7800> PHY Extended Status <3000> PCI Status <10> Jan 21 19:59:57 pve kernel: e1000e 0000:00:1f.6 eno1: Detected Hardware Unit Hang: TDH <a> TDT <90> next_to_use <90> next_to_clean <9> buffer_info[next_to_clean]: time_stamp <10fac799d> next_to_watch <a> jiffies <10fac80f0> next_to_watch.status <0> MAC Status <40080083> PHY Status <796d> PHY 1000BASE-T Status <7800> PHY Extended Status <3000> PCI Status <10> Jan 21 19:59:58 pve kernel: e1000e 0000:00:1f.6 eno1: Reset adapter unexpectedly Jan 21 19:59:58 pve kernel: vmbr0: port 1(eno1) entered disabled state Jan 21 20:00:02 pve kernel: e1000e 0000:00:1f.6 eno1: NIC Link is Up 1000 Mbps Full Duplex, Flow Control: Rx/Tx Jan 21 20:00:02 pve kernel: vmbr0: port 1(eno1) entered blocking state Jan 21 20:00:02 pve kernel: vmbr0: port 1(eno1) entered forwarding state

Hey! Du scheinst an dieser Unterhaltung interessiert zu sein, hast aber noch kein Konto.

Hast du es satt, bei jedem Besuch durch die gleichen Beiträge zu scrollen? Wenn du dich für ein Konto anmeldest, kommst du immer genau dorthin zurück, wo du zuvor warst, und kannst dich über neue Antworten benachrichtigen lassen (entweder per E-Mail oder Push-Benachrichtigung). Du kannst auch Lesezeichen speichern und Beiträge positiv bewerten, um anderen Community-Mitgliedern deine Wertschätzung zu zeigen.

Mit deinem Input könnte dieser Beitrag noch besser werden 💗

Registrieren Anmelden