NEWS

Rhasspy Offline Sprachsteuerung

-

@joergeli

OK, sehe gerade die Rhasspy MQTT-API gibt gar keine Sprachausgabe her. Hast du vielleicht irgendwo erfahren ob sich dies in Zukunft ändern soll?@capitaenz

Bin z.Zt im Streß, ich antworte heute abend ausführlicher.

Nur so viel: Ich hatte ja geschrieben, daß wir die Sprachausgabe über die HTTP-Api machen, weil wir es bis dato nicht über MQTT geschafft haben.

Ich habe das auch in meinem o.a. Script implementiert. -

@joergeli

Super, vielen Dank, es läuft jetzt!

Allerdings musste ich noch etwas probieren und von deiner Anleitung oben abweichen, denn ich musste unter MQTT nicht die IP des ioBroker, sondern die IP des Rhasspy eintragen.

Und das ist es was mich verwirrt. Denn ich bin davon ausgegangen, dass Rhasspy MQTT von haus aus unterstützt, denn es muss ja irgendwie an ein anderes System angebunden werden. Da habe ich geglaubt, dass die Entwickler natürlich MQTT mit eingebaut haben.

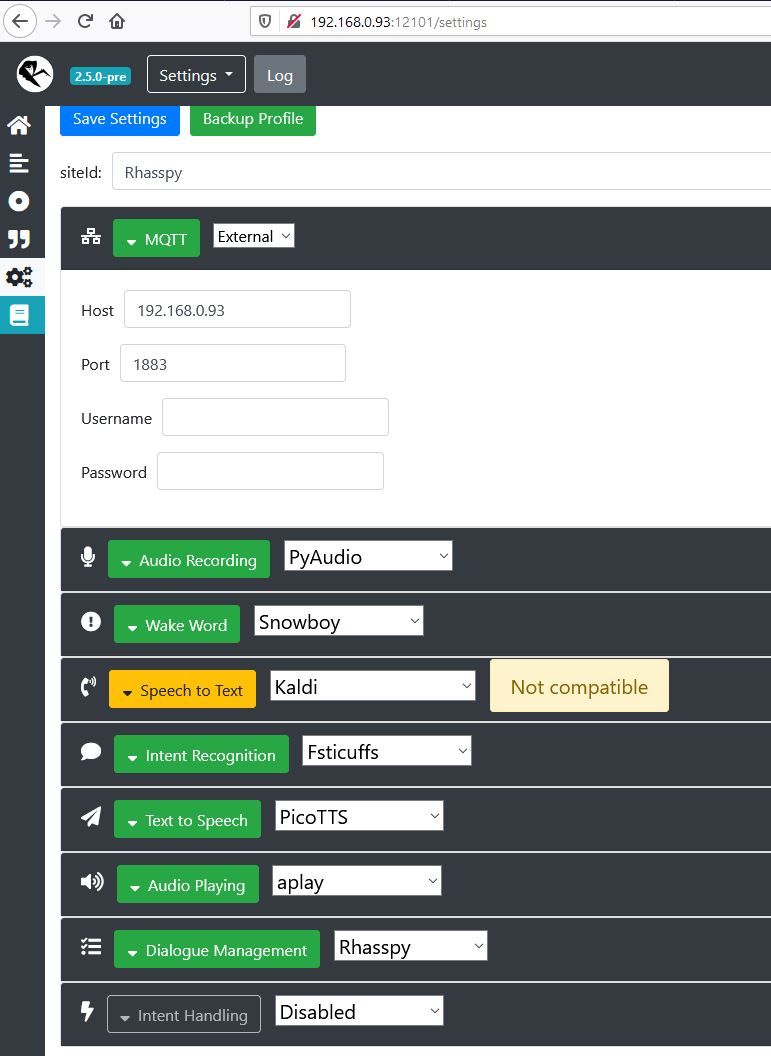

Hier die Einstellungen:

Der Repeaker hat einen Stecker für einen Lautsprecher:

Die LEDs leuchten nur beim Hochfahren kurz auf und bleiben dann leider dunkel.

Jetzt bleibt noch eine weitere Frage, wie bekomme ich wie bei Snips eine Sprachausgabe hin?

Ich stelle mir dies so vor, das ich (wie bei Snips) per MQTT-Datenpunkt den Text übergeben kann.

OK, sehe gerade ich könnte auf die HTTP API ausweichen.

Etwa so: http://192.168.0.93:12101/api/text-to-speech/

Leider finde ich jetzt kein Beispiel wie ich den eigentlichen Text hiermit übergeben kann.

Ich meine http://192.168.0.93:12101/api/text-to-speech/test funktioniert nicht, oder bin ich zu naiv?

Bekomme immer ein:

NotFound: NotFound(404)

Habe mir einen Einzeiler vorgestellt, den ich auch in einem x-beliebigen Browser absetzen kann.

Update, habe jetzt herausgefunden, das man mit:http://<ip>:12101/api/#/default/post_api_text_to_speechetwas Licht ins Dunkel bringen kann und ein Einzeiler, so wie ich geglaubt hatte nicht möglich ist.

Ich komme so langsam wieder an einen Punkt, wo ich nicht sicher bin, ob Snips nicht doch noch die besseren (einfacheren) Möglichkeiten bietet.Hoffe mein Vorhaben ist über MQTT zu realisieren.

Jetzt bleiben für mich noch folgende Punkt offen, damit Rhasspy eine vollwertige Alternative zu Snips wird:- Lautstärke dauerhaft abspeichern, auch nach Reboot

- Sprachausgabe über MQTT oder über Blockly per HTTP

- LEDs zum leuchten bringen

VG

Leif@capitaenz sagte in Rhasspy Offline Sprachsteuerung:

Allerdings musste ich noch etwas probieren und von deiner Anleitung oben abweichen, denn ich musste unter MQTT nicht die IP des ioBroker, sondern die IP des Rhasspy eintragen.

Und das ist es was mich verwirrt. Denn ich bin davon ausgegangen, dass Rhasspy MQTT von haus aus unterstützt, denn es muss ja irgendwie an ein anderes System angebunden werden. Da habe ich geglaubt, dass die Entwickler natürlich MQTT mit eingebaut haben.Hatte ich nicht geschrieben, daß die IP des MOSQUITTO, also letztendlich die des Rhasspys eingetragen werden muss?

1.) Lautstärke dauerhaft abspeichern:

Kann ich nichts zu sagen, da ich für die Sprachausgabe den ioBroker PAW-Adapter nutze, der die Antworten auf einem Android-Tablet ausgibt.

Ausgabe über Lautsprecher hatte ich nur temporär über die 3,5mm Klinkenbuchse getestet.

Evtl.kann @tobetobe mehr dazu sagen?2.) Sprachausgabe über MQTT

Rhasspy hat einen internen MOSQUITTO, aber leider kann man - nach unseren Tests - darauf von außen (ioBroker) nicht zugreifen. Deshalb der Workaround mit dem zusätzlichen MOSQUITTO auf dem Rhasspy, auf den dann von ioBroker aus subscribed wird.

Wie schon erwähnt, konnte man mit der vorigen Rhasspy-Version 2.4.19 noch auf den internen MOSQUITTO zugreifen, bzw. dort einen externen MQTT (IP-iobroker/Port-beliebig) eintragen, das funktioniert - aus welchen Gründen auch immer - nicht mehr mit der Rhasspy V2.5-pre. Das hatte ich auch in einem issue schon gemeldet.

Evtl. wird das seitens Rhasspy noch gefixed?Du musst auch bedenken, daß Rhasspy nicht speziell für ioBroker gemacht ist, sondern primär für andere Systeme wie Home Assistant, Hass.io, und Node-RED.

Hier noch mal mein (gekürztes) JavaScript, welches nur die Sprachausgabe via HTTP-API über Lautsprecher macht.

Die Sprachbefehle werden aber weiterhin über die MQTT-API gesendet.

(bei Blockly bin ich raus)In Rhasspy habe ich dazu für die Sprachausgabe "Text to Speech" --> PicoTTS --> Language: de-DE gewählt,

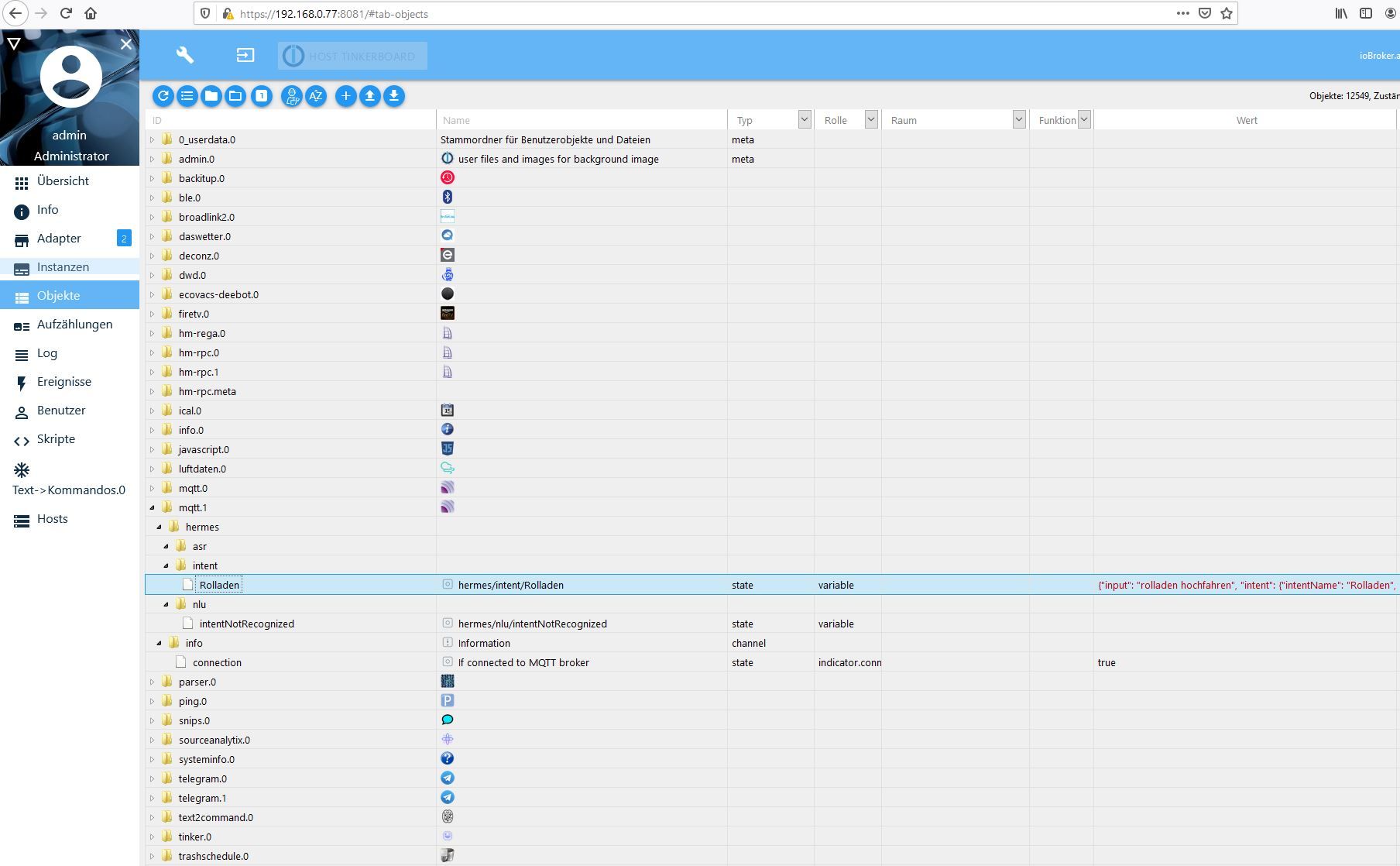

was m.E. am natürlichsten klingt.//########################################################################## // Rhasspy-Voltron-intents (hier nur Rolladen) via MQTT-Client empfangen und entspr.Datenpunkte setzen/schalten // Ausgabe ueber Lautsprecher //########################################################################## // Für Sprachausgabe auf via HTTP-API auf Rhasspy let http = require('http'); let options = { host: 'xxx.xxx.xxx.xxx', //Hier Rhasspy IP-Adresse eintragen port: 12101, //Rhasspy Port muss so bleiben (HTTP-Api) path: "/api/text-to-speech", method: 'POST', headers: { 'User-Agent' : 'ioBroker', 'Content-Type': 'text/plain', // 'Content-Length': data.length } }; //______________________________________________________________________________ function httpPost(data) { let req = http.request(options, function(res) { //console.log("http Status: " + res.statusCode); // Header (Rückmeldung vom Webserver) //console.log('HEADERS: ' + JSON.stringify(res.headers), (res.statusCode != 200 ? "warn" : "info")); }); // Fehler abfangen req.on('error', function(e) { console.log('ERROR: ' + e.message,"warn"); }); // write data to request body //console.log("Data to request body: " + data); // (data ? req.write(data) : console.log("Daten: keine Daten vorhanden")); req.write(data); req.end(); } //______________________________________________________________________________ const rolladen = 'mqtt.1.hermes.intent.Rolladen' // Rolladen // Rolladen on({id: rolladen, change: "any"},function(obj) { let empf_code = getState(rolladen).val ; let empf_json = JSON.parse(empf_code); let name = empf_json.slots[0].value.value; //log ("name: " + name); let state = empf_json.slots[1].value.value; //log ("state: " + state); //log ("name: " + name + " state: " + state); if (name == "rolladen" && state == "hochfahren"){ //setState ('hm-rpc.0.PEQ0505813.1.STATE', true); // <--Hier entspr. Aktor eintragen let data = name + ' werden hochgefahren'; httpPost(data); } else if(name == "rolladen" && state == "runterfahren"){ //setState ('hm-rpc.0.PEQ0505813.3.STATE', true); // <--Hier entspr. Aktor eintragen let data = name + ' werden runtergefahren'; httpPost(data); } else if(name == "rolladen" && state == "stoppen"){ //setState ('hm-rpc.0.PEQ0505813.2.STATE', true); // <--Hier entspr. Aktor eintragen let data = name + " werden gestoppt "; httpPost(data); } }); //_____ Ende Rolladen-Auswertung _________________________________________ //################################################################################################ // WakeWord-Erkennung const wake = 'mqtt.1.hermes.asr.startListening' // Wakeword erkannt const unbekannt = 'mqtt.1.hermes.nlu.intentNotRecognized' // Datenpunkt Intent nicht erkannt on({id: wake, change: "any"},function(obj) { wakeword(); }); on({id: unbekannt, change: "any"},function(obj) { nicht_erkannt(); }); function wakeword(){ let data = "ja?" ; httpPost(data); } function nicht_erkannt(){ let data = "Entschuldigung, ich habe dich leider nicht verstanden"; httpPost(data); } // Ende WakeWord-ErkennungsScript //################################################################################################Das sollte so funktionieren:

Du sagst "snowboy" --> Rhasspy antwortet über Lautsprecher "ja?"

Du sagst sofort nach dem "ja?" --> "rolladen hochfahren" --> Rhasspy antwortet über Lautsprecher "rolladen werden hochgefahren".

Teste mal, ob das bei Dir funktioniert.3.) LEDs zum leuchten bringen

Versuch mal, anstatt "kiboost" den LED-Pattern "projectalice":sudo systemctl stop hermesledcontrol

sudo nano /etc/systemd/system/hermesledcontrol.service --> hier anstatt kiboost del LED-pattern projectalice eintragen

sudo systemctl daemon-reload

sudo systemctl start hermesledcontrolIch kann aber nicht garantieren, daß das mit Deinem Respeaker 2-Mic funktioniert, da ich es nur mit meinem Respeaker 4 testen kann.

--

Wie mir in Deinem obigen Screenshot aufgefallen ist, wurde anscheinend Kaldi nicht installiert (--> not compatible)?

Falls dem so ist, muß der Docker-Container nochmals neu erstellt werden.

Das beschreibe ich, falls es wirklich zutrifft.

Nach unserer Erfahrung ist von den verschiedenen Optionen der Spracherkennung, Kaldi die zuverlässigste, bzw. genaueste.Gruß

Jörg -

Hat schon jemand versucht die Github Version zu installieren? Ich habe da drin leider nicht genug Routine. Habe mal den Docker von rhasspy/rhasspy installiert ( Last updated a day ago by rhasspy ) leider reagiert er weiterhin nicht auf das Wake Word.

-

hallo Leute,

Danke für die vielen Infos.

Aber bei mir bleiben noch ein paar Fragen offen:

Kann man den Docker auch unter Proxmox installieren?

Dann wäre meine "Cloud" im Netzwerkschrank im Keller.

Als Sateliten habe ich 4 Raspberies angedacht, die in verschiedenen Räumen verteilt werden sollen.

Der Raspberry PI3 würde als Satelit reichen?Gruß,

Mathias -

hallo Leute,

Danke für die vielen Infos.

Aber bei mir bleiben noch ein paar Fragen offen:

Kann man den Docker auch unter Proxmox installieren?

Dann wäre meine "Cloud" im Netzwerkschrank im Keller.

Als Sateliten habe ich 4 Raspberies angedacht, die in verschiedenen Räumen verteilt werden sollen.

Der Raspberry PI3 würde als Satelit reichen?Gruß,

MathiasHallo und willkommen in dieser Runde,

@MathiasJ said in Rhasspy Offline Sprachsteuerung:

Kann man den Docker auch unter Proxmox installieren?

Mit Proxmox habe ich persönlich leider keine Erfahrung, habe aber soeben mal das wesentliche hierzu schnell überflogen.Wenn ich das richtig verstanden habe, handelt es sich bei Proxmox um eine Linux basierte Virtualisierungsumgebung. Docker in Linux zu installieren, ist gar kein Problem. Auch habe ich Rhasspy, und damit Docker, schon in VMs, die auf Oracle Virtual Box basierten, ohne Probleme installieren können. Nach meiner Einschätzung, sollte das, was du vorhast, also auch machbar sein. Vielleicht gibt es einige Spezialitäten, die zu beachten sind. Versuch es einfach mal mit der Standardprozedur, wie sie @capitaenz oben beschrieben hat:

.

@capitaenz said in Rhasspy Offline Sprachsteuerung:

Ich fasse jetzt hier die Arbeit der letzten Tage zusammen, damit weitere Leute von Snips zu Rhasspy wechseln können:

@MathiasJ said in Rhasspy Offline Sprachsteuerung:

Der Raspberry PI3 würde als Satelit reichen?

Absolut, es genügt sogar ein Pi Zero für einen Satelliten. Wie schon oben erwähnt: Das Mikrofon ist das entscheidende Element.

Trau dich einfach mal ran, wir helfen gerne weiter.

Gruß

Thomas -

Hat schon jemand versucht die Github Version zu installieren? Ich habe da drin leider nicht genug Routine. Habe mal den Docker von rhasspy/rhasspy installiert ( Last updated a day ago by rhasspy ) leider reagiert er weiterhin nicht auf das Wake Word.

@capitaenz said in Rhasspy Offline Sprachsteuerung:

Hat schon jemand versucht die Github Version zu installieren?

Nein, ich sehe dazu auch keine Veranlassung. Der normale Pull mit dem dir bekannten Kommando genügt mMn vollkommen. Was versprichst du dir davon, ggf. eine Beta-Version von einer Beta-Version zu installieren?

Wenn es dir um die Lösung dieses Problems geht:

@capitaenz said in Rhasspy Offline Sprachsteuerung:

leider reagiert er weiterhin nicht auf das Wake Word.

dann wirst du die Lösung nicht durch die Installation der GitHub-Version finden. Das Problem muss in deiner Konfiguration liegen.

Hast du alles so, wie es @joergeli dir geschrieben hat, getestet? Wenn nicht, mach das erst einmal, bevor du neue Fässer aufmachst. Das ist nicht zielführend.

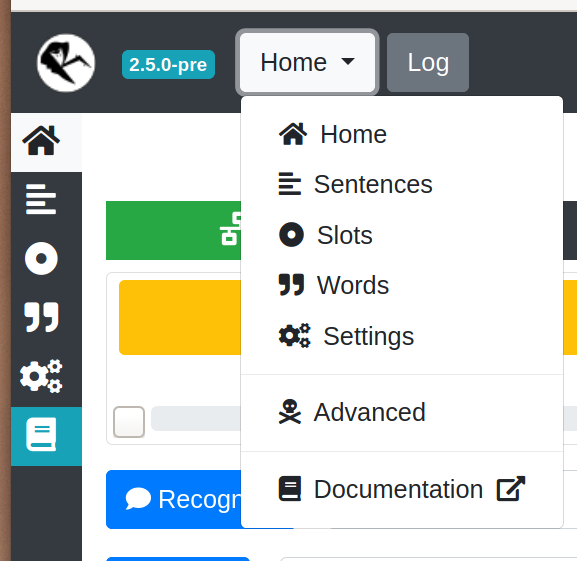

Wenn du uns hier deine Konfigurationen postest, und zwar einmal grafisch (die Einstellungen), und dann als Text (Kopie vom Profile), dann könnten wir mal drüberschauen, was da nicht stimmt. meistens sind es nur Kleinigkeiten.Das Profil findest du unter Home/Advanced

-

@tobetobe

Ich erhoffe mir dadurch eine Fehlerfreie Version von Rhasspy installiert zu bekommen, denn der Fehler ist ja bekannt:@joergeli said in Rhasspy Offline Sprachsteuerung:

Wie schon erwähnt, konnte man mit der vorigen Rhasspy-Version 2.4.19 noch auf den internen MOSQUITTO zugreifen, bzw. dort einen externen MQTT (IP-iobroker/Port-beliebig) eintragen, das funktioniert - aus welchen Gründen auch immer - nicht mehr mit der Rhasspy V2.5-pre. Das hatte ich auch in einem issue schon gemeldet.

-

@tobetobe

Ich erhoffe mir dadurch eine Fehlerfreie Version von Rhasspy installiert zu bekommen, denn der Fehler ist ja bekannt:@joergeli said in Rhasspy Offline Sprachsteuerung:

Wie schon erwähnt, konnte man mit der vorigen Rhasspy-Version 2.4.19 noch auf den internen MOSQUITTO zugreifen, bzw. dort einen externen MQTT (IP-iobroker/Port-beliebig) eintragen, das funktioniert - aus welchen Gründen auch immer - nicht mehr mit der Rhasspy V2.5-pre. Das hatte ich auch in einem issue schon gemeldet.

@capitaenz said in Rhasspy Offline Sprachsteuerung:

Ich erhoffe mir dadurch eine Fehlerfreie Version von Rhasspy installiert zu bekommen, denn der Fehler ist ja bekannt:

Für mich nicht nachvollziehbar. Wir haben dir ein einwandfrei funktionierendes System an die Hand gegeben. Mit dem könntest du ohne Probleme arbeiten. Jetzt unbedingt mit dem ioBroker MQTT Adapter arbeiten zu wollen, erscheint mir als reine Liebhaberei. Sachlich / funktional gibt es dafür keinen Anlass. Ich würde die weitere Entwicklung einfach abwarten. Synthesiam wird eine Lösung schon eines Tages präsentieren.

Und wie gesagt: Dass dein Wakeword nicht erkannt wird, hat mit dem gemeldeten Fehlverhalten wirklich gar nichts zu tun.

-

@capitaenz said in Rhasspy Offline Sprachsteuerung:

Ich erhoffe mir dadurch eine Fehlerfreie Version von Rhasspy installiert zu bekommen, denn der Fehler ist ja bekannt:

Für mich nicht nachvollziehbar. Wir haben dir ein einwandfrei funktionierendes System an die Hand gegeben. Mit dem könntest du ohne Probleme arbeiten. Jetzt unbedingt mit dem ioBroker MQTT Adapter arbeiten zu wollen, erscheint mir als reine Liebhaberei. Sachlich / funktional gibt es dafür keinen Anlass. Ich würde die weitere Entwicklung einfach abwarten. Synthesiam wird eine Lösung schon eines Tages präsentieren.

Und wie gesagt: Dass dein Wakeword nicht erkannt wird, hat mit dem gemeldeten Fehlverhalten wirklich gar nichts zu tun.

-

hallo Leute,

Danke für die vielen Infos.

Aber bei mir bleiben noch ein paar Fragen offen:

Kann man den Docker auch unter Proxmox installieren?

Dann wäre meine "Cloud" im Netzwerkschrank im Keller.

Als Sateliten habe ich 4 Raspberies angedacht, die in verschiedenen Räumen verteilt werden sollen.

Der Raspberry PI3 würde als Satelit reichen?Gruß,

Mathias@MathiasJ

"Kann man den Docker auch unter Proxmox installieren?

Dann wäre meine "Cloud" im Netzwerkschrank im Keller."Warum möchtest du eine Virtualisungsumgebung (Docker) unter eine Virtualisungsumgebung (Proxmox) installieren?

-

@MathiasJ

"Kann man den Docker auch unter Proxmox installieren?

Dann wäre meine "Cloud" im Netzwerkschrank im Keller."Warum möchtest du eine Virtualisungsumgebung (Docker) unter eine Virtualisungsumgebung (Proxmox) installieren?

@zahnheinrich

Weil unter Proxmox bereits freePBX, RaspberryMatic und IObroker laufen. Sonst müsste ich einen weiteren PC, sei es nur einen Raspberry bemühen.

Das ist genau das, was ich verhindern will. -

@zahnheinrich

Weil unter Proxmox bereits freePBX, RaspberryMatic und IObroker laufen. Sonst müsste ich einen weiteren PC, sei es nur einen Raspberry bemühen.

Das ist genau das, was ich verhindern will.@MathiasJ Und warum installierst du den rasspy nicht in Proxmox?

-

dazu muß ich in Proxmox wohl erst Docker installieren?https://community.rhasspy.org/t/rhasspy-voice-server-at-proxmox-possible/590

ja, erst Docker, dann Rhaspy

-

@capitaenz said in Rhasspy Offline Sprachsteuerung:

Ich erhoffe mir dadurch eine Fehlerfreie Version von Rhasspy installiert zu bekommen, denn der Fehler ist ja bekannt:

Für mich nicht nachvollziehbar. Wir haben dir ein einwandfrei funktionierendes System an die Hand gegeben. Mit dem könntest du ohne Probleme arbeiten. Jetzt unbedingt mit dem ioBroker MQTT Adapter arbeiten zu wollen, erscheint mir als reine Liebhaberei. Sachlich / funktional gibt es dafür keinen Anlass. Ich würde die weitere Entwicklung einfach abwarten. Synthesiam wird eine Lösung schon eines Tages präsentieren.

Und wie gesagt: Dass dein Wakeword nicht erkannt wird, hat mit dem gemeldeten Fehlverhalten wirklich gar nichts zu tun.

-

das erste ist getan,,,,, Rhasspy läuft auf dem Proxmox :)

Nur eine Verständnisfrage:

Muß ich die Rhasspy-Sateliten auch wie den Server (dieses mal auf den Raspberries) im Docker installieren.

Ich habe dazu leider nichts gefunden.

Wie kommt man auf das kauderwelsch beim Training?

Als Beispiel nehme ich das Garagenlicht:G AH RR AAH ZH AX N L IH CC TGruß,

Mathias -

das erste ist getan,,,,, Rhasspy läuft auf dem Proxmox :)

Nur eine Verständnisfrage:

Muß ich die Rhasspy-Sateliten auch wie den Server (dieses mal auf den Raspberries) im Docker installieren.

Ich habe dazu leider nichts gefunden.

Wie kommt man auf das kauderwelsch beim Training?

Als Beispiel nehme ich das Garagenlicht:G AH RR AAH ZH AX N L IH CC TGruß,

Mathias@MathiasJ

Guten Morgen,

das ist ja schon mal erfreulich. Zu deinen weiteren Fragen: Hier findest du ein Tutorial, wie ein Master-Satellite System zu installieren und zu konfigurieren ist:https://rhasspy.github.io/rhasspy-voltron/tutorials.html#getting-started-guideUnd ja, auch hier Docker. Alternativ geht auch eine Python VENV. Aber warum bei Master und Satellite unterschiedliche Wege einschlagen. Ich empfehle dir Docker. Gleich der Zweite Punkt ganz oben führt dich zur Installationsanweisung. Wichtig: achte auf die unterschiedlichen Ports!!!

Kauderwelsch beim Training: Gibt es nur beim Master. Die Vorschläge kommen automatisch vom System. Du kannst sie dir anhören. Wenn dir die Aussprache nicht gefällt, kannst du sie anpassen. Gelegentlich ist es besser, einen lang gesprochenen Vokal zu verkürzen, damit die Aussprache keinen amerikanischen Akzent hat. Und Achtung: Die Kiste spricht so, wie du es eingibst. Also: 5 als fuenf geschrieben spricht sich "fu-enf", und fünf ist fünf. Auch so kannst du also bestimmte Worte an deine Aussprache anpassen.

Good Luck. Und bei Fragen einfach fragen.

-

@tobetobe

Danke, schaue ich mir gleich an.

Bin gerade am Server und versuche mich mit den Custom Words.

Gibt es ach andere Stimmen? Die ist richtig grässlich.....

Oder ist die nur zum kontrollieren und die, die ich im laufendem betrieb höre ist eine andere?ich habe da noch etwas anderes gefunden: https://community.home-assistant.io/t/rhasspy-offline-voice-control-step-by-step-server-client-docker/154015

-

@tobetobe

Danke, schaue ich mir gleich an.

Bin gerade am Server und versuche mich mit den Custom Words.

Gibt es ach andere Stimmen? Die ist richtig grässlich.....

Oder ist die nur zum kontrollieren und die, die ich im laufendem betrieb höre ist eine andere?ich habe da noch etwas anderes gefunden: https://community.home-assistant.io/t/rhasspy-offline-voice-control-step-by-step-server-client-docker/154015

@MathiasJ said in Rhasspy Offline Sprachsteuerung:

Gibt es ach andere Stimmen?

Also die Umwandlung von Text in Sprache (TTS - TextToSpeech) wird im Master eingestellt. Es stehen verschiedene Module zur Verfügung, die im Konfigurationsmenü angeboten werden. Standard ist Espeak, was in der tat recht grausig klingt. Weitaus besser ist PicoTTS, was ich aus eigener Erfahrung heraus als recht angenehm empfinde. Wie schon zuvor mitgeteilt, kann es in Ausnahmefällen mal erforderlich sein, die Aussprache etwas anzupassen. Du kannst das ja mal testen, wie sich die verschiedenen Schreibweisen anhören:

G AH RR AAH ZH AX N L IH CC T G AAH RR AAH ZH AX N L IH CC T G AAH RR AH ZH AX N L IH CC T G AH RR AAH ZH AX N L IIH CC T@MathiasJ said in Rhasspy Offline Sprachsteuerung:

Oder ist die nur zum kontrollieren und die, die ich im laufendem betrieb höre ist eine andere?

Ich bin mir da nicht ganz sicher (weil ich es für dich nicht nochmals überprüfen konnte), aber ich glaube, dass die Aussprache in beiden Fällen vom ausgewählten TTS-System abhängt.

Mary TTS soll übrigens auch sehr gut sein, das habe ich allerdings noch nicht getestet. Warte ein wenig, dann komme ich darauf wieder zurück - oder teste MaryTTS selbst und teile deine Erfahrungen.

@MathiasJ said in Rhasspy Offline Sprachsteuerung:

ich habe da noch etwas anderes gefunden:

Das ist eine alte Quelle aus dem Dezember 2019. Sie bezog sich noch auf Version 2.4.x und ist nicht mehr relevant. Zu 2.5 gab es gravierende Veränderungen. Bitte arbeite mit dem Verweis, den ich dir bereitgestellt habe.

-

@tobetobe

Wenn man nicht mit Skripten arbeiten möchte, dann benötigt man eine "saubere" Lösung für Blockly.

Ich möchte mich jetzt aber nicht hier in einem Wortgefecht wiederfinden, danke für die Unterstützung.VG

Leif@capitaenz said in Rhasspy Offline Sprachsteuerung:

Wenn man nicht mit Skripten arbeiten möchte, dann benötigt man eine "saubere" Lösung für Blockly.

Bitte Leif, bleib bei der Sache. Du erweckst hier im Forum für andere Interessierte mit falschen Aussagen einen irritierenden Eindruck, den ich so nicht stehen lassen kann.

@joergeli hat dir einen sauberen UND stabil funktionierenden UND absolut gleichwertigen Weg im Anschluss an die erfolgreiche Rhasspy-Installation beschrieben:

- Installation eines Mosquitto-Brokers

- Installation eines mqtt-Clients unter ioBroker

Das Ganze geht mit minimalem Aufwand und frisst fast keine Ressourcen. Damit stehen dir alle relevanten Datenpunkte, die von Rhasspy generiert werden, zur weiteren Verarbeitung durch irgend eine Skriptsprache, die dir genehm ist zur Verfügung. Unter ioBroker sind dies Javascript, Blockly und Node-Red.

Also: Du willst mit Blockly arbeiten, und kannst es auch. Von daher ist es für andere Interessierte nicht hilfreich, wenn du es so darstellst, wie wenn das Arbeiten mit Blockly bei Rhasspy Version 2.5 nicht möglich wäre.

Und auch wenn du mit Blockly arbeitest, erzeugst du Skripte, die bestimmten Abläufen folgen. Dass Blockly nichts mit Skripten zu tun hat, ist von dir ebenfalls schlichtweg falsch dargestellt.

Hey! Du scheinst an dieser Unterhaltung interessiert zu sein, hast aber noch kein Konto.

Hast du es satt, bei jedem Besuch durch die gleichen Beiträge zu scrollen? Wenn du dich für ein Konto anmeldest, kommst du immer genau dorthin zurück, wo du zuvor warst, und kannst dich über neue Antworten benachrichtigen lassen (entweder per E-Mail oder Push-Benachrichtigung). Du kannst auch Lesezeichen speichern und Beiträge positiv bewerten, um anderen Community-Mitgliedern deine Wertschätzung zu zeigen.

Mit deinem Input könnte dieser Beitrag noch besser werden 💗

Registrieren Anmelden